Was du lernen wirst

- Nutze ChatGPT wie einen KI-Textgenerator, Coach für Bewerbungsgespräche und mehr, indem du bessere Prompts schreibst (dank FÜNF verschiedenen Prompt-Bauplänen!).

- Das Bedienen von GPT im Chat ähnelt dem Bedienen der API als Entwickler.

- Verbessere deine Befehle, dank der deutschsprachigen Prompt-Sammlung für ChatGPT.

- Finde heraus, wie du ChatGPT auf Deutsch umstellst.

- Erfahre mehr über ChatGPT-Plugins.

- Erfahre mehr über den API-Zugang für Entwickler.

- GPT-Sprachmodelle (API) erhalten Update (Stand: 15. Juni 2023). API: GPT-3.5-turbo erhält statt 4.000 Token ein Update auf 16.000 Token; GPT-4 mit 32.000 Token bleibt bestehen.

- OpenAI bietet ChatGPT als App für Google Android und Apple iOS an.

ChatGPT ist eine Künstliche Intelligenz, die auf deine Texte reagiert. Du kannst sie als KI-Textgenerator, SEO-Helfer oder Prompt-Generator verwenden. In diesem Artikel erfährst du alles, was du über ChatGPT wissen musst: Wie du es auf Deutsch umstellst, wie du bessere Prompts schreibst und anwendest, welche Plugins und Alternativen es gibt und wie du dich für die Entwickler-API anmeldest.

Inhaltsverzeichnis

Glossar

Ein Glossar mit wichtigen Begriffen, die im Inhalt stehen.

- OpenAI: OpenAI ist ein Unternehmen, das an Künstlicher Intelligenz forscht. Es entwickelt die GPT-Sprachmodelle, darunter auch GPT-3.5-Turbo, welches im gratis ChatGPT eingesetzt wird.

- GPT: Generative Pre-trained Transformer ist ein Sprachmodell, welches mit Transformer-Architektur große Mengen an unstrukturierten Textdaten analysieren und daraus Texte erstellen kann.

- Large Language Model (LLM): Large Language Model (zu Deutsch: Großes Sprachmodell) sind Modelle wie GPT und sollen Maschinen menschliche Sprache verstehen lassen.

- Natural Language Processing (NPL): Natural Language Processing (zu Deutsch: Natürliche Sprachverarbeitung) ist der Prozess, bei der Menschensprache vom Sprachmodell verarbeitet wird, indem angelernte Muster erkannt, Reaktionen ausgeführt werden.

- Prompt: Eine Anweisung für eine KI.

- Prompt Engineering: Prompt Engineering bezeichnet die Kunst und Wissenschaft einer Maschine ihre Aufgabe zu erklären und die folgenden Ausgaben analysieren und verbessern zu können.

- Maschinelles Lernen: Eine Maschine simuliert die Lernfähigkeit eines Menschens. Dazu wird ein Netz aus Funktionen (Neuronales Netz), die dem menschlichen Hirn „nachempfunden“ sind.

Was ist ChatGPT?

| Veröffentlicht | 30. November 2022 |

| Hersteller | OpenAI |

| Standort | San Francisco, USA |

| Personen | Sam Altman (CEO), Elon Musk (Co-founder) |

| Finanzierung | Microsoft, Reid Hoffman, Khosla Ventures, |

| Nutzer | 1,6 Milliarden |

| Technologie | GPT-3.5 (Kostenfrei), GPT-4 (GPT Plus) |

| Preis | Kostenfrei oder 20 $ / Monat |

ChatGPT ist ein Prototyp eines Chatbots, der menschenähnliche Textausgaben erzielt. Dieser Bot basiert auf der GPT-3.5 (- Turbo) und GPT-4 Sprachmodell-Linie von OpenAI. Die GPT-Modelle sind Instruction Tuned Large Language Models und sind darauf programmiert, Befehle auszuführen und dementsprechend beispielsweise Texte zu erstellen.

GPT bedeutet Generative Pre-trained Transformer und arbeitet mit einer Transformer-Architektur, die unmengen an Textdaten analysieren kann.

Die KI wurde im November 2022 veröffentlicht.

Künstliche Intelligenz ist ein Oberbegriff für maschinelles Lernen, bei dem Maschinen beigebracht wird, Muster zu erkennen und auf diese Muster zu reagieren.

GPT wurde sowohl überwacht als auch selbstständigen Lernen unterzogen. Und es wurde Bestärkendes Lernen (reinforcement learning) eingesetzt, bei welchem die Software eigenständig Strategien entwickelt, Erlerntes aussichtsreich zu verwenden, um den Erhalt von Belohnungen zu maximieren. Als Lernmaterial wurden sowohl KI-Trainer eingesetzt als auch allerlei verwertbarer Datensätze, unter anderem auch Inhalte aus dem Internet. Das Ziel für GPT ist es, einen menschenähnlichen Konversationsstil zwischen Mensch und Maschine zu ermöglichen. Deshalb unterstützt der Chatbot auch seine Fähigkeit, auf den vorhergegangenen Chat zurückzugreifen.

Durch das Deep Learning entwickelt sich die Fähigkeit des Natural Language Processing (zu Deutsch: Natürliche Sprachverarbeitung). Ein Mensch gibt einer Maschine wie ChatGPT einen Befehl (auch prompt genannt) und die Maschine erwidert durch eine, der Mustererkennung dank Training nach, sinnvolle Ausgabe. Diese Prompts, wie man die Befehle im KI-Jargon bezeichnet, können hierbei alles sein: Einfache Fragen: „Wie erweitere ich meinen Wortschatz?“, oder Aufgabenabläufe für komplexe Prozesse wie Umrisse für Blogartikel erstellen und bei Gefallen nach und nach strukturiert durch Schreiben ausarbeiten zu lassen.

Laut offiziellen OpenAI-(Prompt)-Kochbuch auf GitHub heißt es, dass GPT ohne konkrete Programmierung, beim Lernen mit Textmaterial nebenher die Fähigkeit für folgende Beispiele erlangt habe:

- Programmiercode Schreiben,

- Grammatik Korrigieren,

- Dialoge führen,

- Zusammenfassung von Text erstellen,

- Mehrsprachige Ausgaben und mehr.

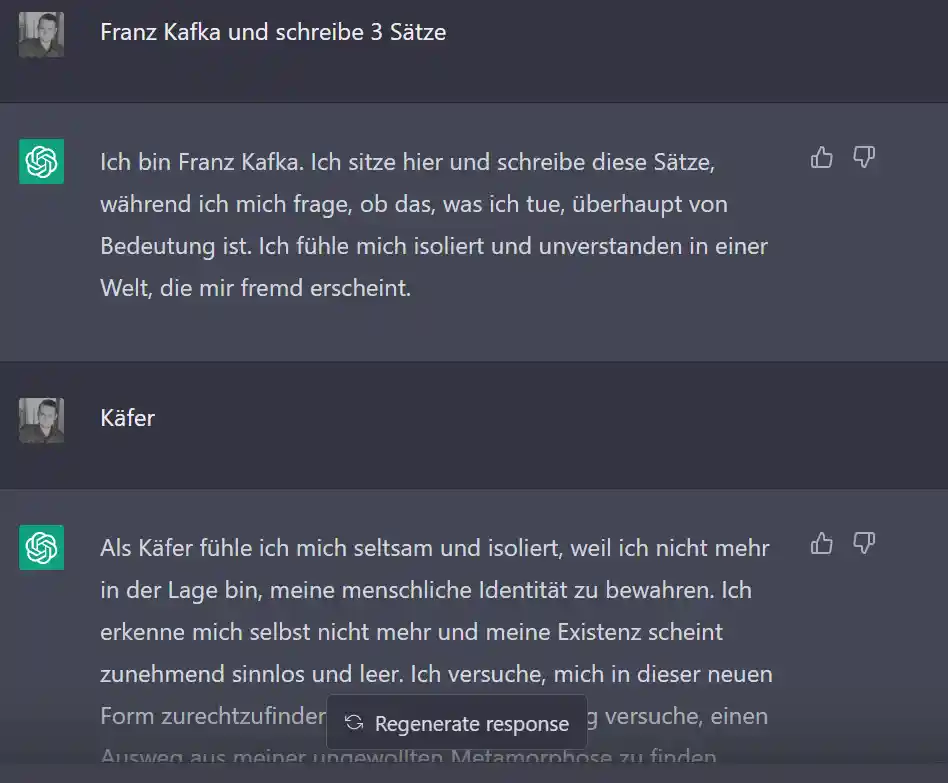

Beispielhaft: Möchtest du einem Chatbot beibringen, in deinen Worten zu schreiben? Gebe dem Bot diesen Befehl! ChatGPT etwa fragt dich nach einigen Textbeispielen deiner Schriften. Das können Tagebucheinträge sein oder Briefe, Aufsätze: alles, wo deine Art für Wortwahl und Satzbau durchscheint.

Mittels folgenden Prompt-Beispiel forderst du ChatGPT auf, den Stil von jemanden zu analysieren und nachzuahmen. Der Chatbot wird dich um Textbeispiele bitten.

Beispiel:

Ich gebe dir Textbeispiele von James. Anhand der Beispiele sollst du seinen Schreibstil analysieren und später nachahmen. Verstanden?GPT wird sich derzeit nicht ewig an deine Stilvorgaben erinnern: schon gar nicht übergreifend auf weitere Chats. Womöglich wird dieser Umstand bald durch Plugins umgekehrt und jeder kann einen eigenen Speicher für eine Art privates GPT-Gedächtnis verwenden.

Neue ChatGPT-Funktionen im Blick

Innerhalb der nächsten Unterpunkten siehst du neue ChatGPT-Funktionen die für Nutzer ausgerollt werden.

ChatGPT-4o: Neue Version, auch für gratis Nutzer

OpenAI hat just eine neue GPT-Version angekündigt: GPT-4o. Die ersten Nutzer erhalten bereits Zugang. Der Entwickler sagt, GPT-4o sei klüger, jedoch langsamer als etwa GPT-3.5.

Custom-ChatGPT-Modelle: GPTs

OpenAI hat seine erste Dev-Konferenz abgehalten und einiges vorgestellt. Besonders spannend für die meisten Nutzer: GPTs: Eine Möglichkeit für maßgeschneiderte und indivudelle GPT-Modelle.

ChatGPT analysiert Daten der Nutzer

Aktuell erhalten mehr und mehr Nutzer ohne Plus-Abo einen GPT-4 Alpha-Zugang.

Erfahre Mehr: GPT-4 Alpha mit allen Tools.

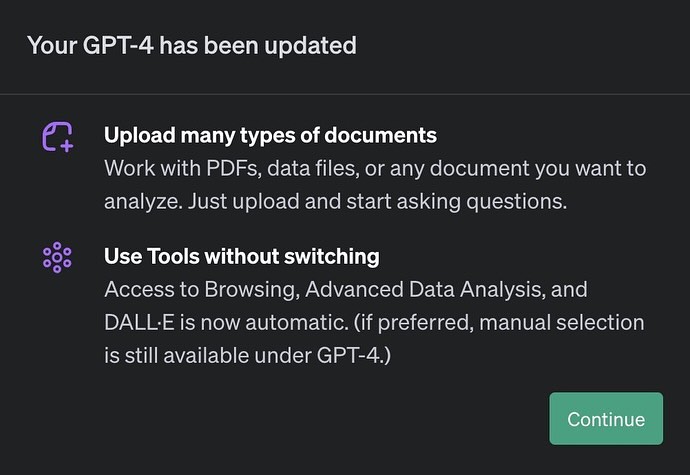

Abonnenten der ChatGPT-Plus-Mitgliedschaft rollt sich zeitig eine neue Funktion zum Dateiupload und -Analyse aus.

Es sind neue beta Funktionen für ChatGPT-Nutzer mit Plus-Abo. Das Update beinhaltet die Möglichkeit, Dateien hochzuladen. Mit diesen Daten kann hinterher gearbeitet werden.

Welche Funktionen bietet die Datenanalyse-Funktion von GPT-4?

- Beispielhaft lädt der Nutzer ein Bild hoch und trägt der AI auf, sie solle dieses Bild mittels AI Image Generator DALL-E 3 umgestalten.

- GPT-Data-Analyzer kann den Inhalt von Textdokumenten wie PDF wiedergeben und zusammenfassen.

- Script-Dateien wie .js auf Syntax-Fehler kontrollieren oder Tipps für besseren Code-Style geben.

Zukünftig entscheidet übrigens GPT, welchen Modi es für eine Aufgabe braucht. Das Sprachmodell wählt beispielsweise selbst den Modus wie: „Browse with Bing“.

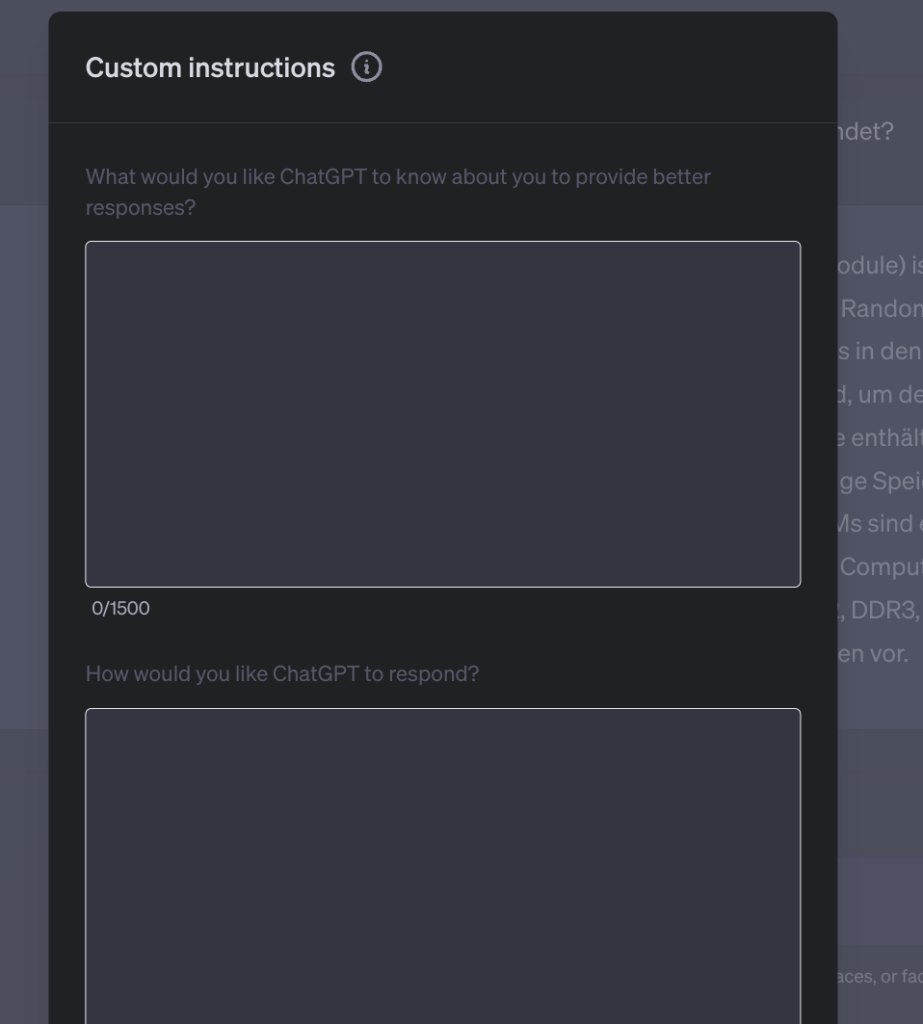

ChatGPT Custom Instructions: Benutzerdefinierte Anweisungen

Jedoch bietet ChatGPT mittlerweile die Option von benutzerdefinierten Anweisungen an. App-Intern heißt die Funktion: Custom Instruction.

Mittels Custom Instruction lassen sich individuell Eingaben voreinstellen. Einerseits können wir der Texter-KI vorgegeben, wie sie uns betrachten soll. Andererseits können wir die Ausgaben anpassen.

Beispielsweise könntest du GPT somit erklären, du seist Lehrer und richtest dich an Schüler, Auszubildende oder wie auch immer. Auf die Frage, wie ChatGPT seine Ausgaben vornehmen soll, schreibst du beispielsweise, dass jegliche Antworten in Metaphern verpackt ausgegeben werden sollen.

ChatGPT App für dein Smartphone

Jüngst bietet OpenAI Smartphone-Apps an, es gibt eine App für Android und iOS.

Wahrscheinlich diene dieser Schritt mehr dem Werben beziehungsweise den Trittbrettfahrern den Wind aus den Segeln zu nehmen. Oder eben des plumpen Daten-Abgrasens.

Einen wirklichen Nutzen erkennt man nicht.

Schließlich lässt sich ChatGPT seit Veröffentlichung im Mobile-Browser verwenden.

Der vollständigkeitshalber findest du die passenden Links in nächster Tabelle. Ich empfehle dir jedoch den Browser weiterhin zu nutzen. Dort werden weniger deiner Daten ausgelesen.

| Android-App ChatGPT | iOS-App ChatGPT |

|---|---|

| ChatGPT im Playstore | ChatGPT im Appstore |

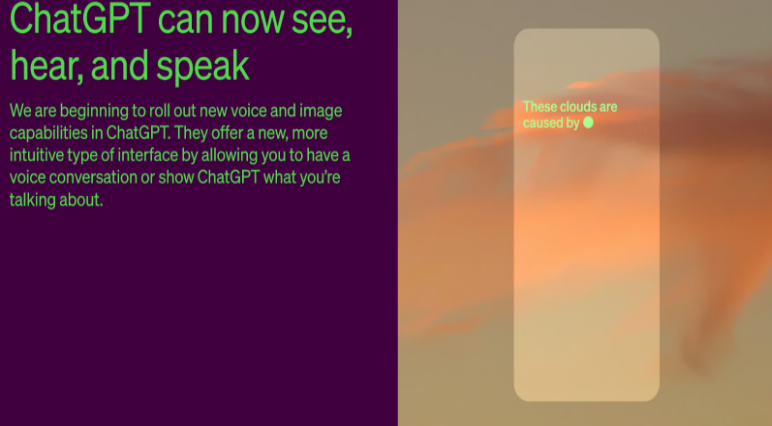

ChatGPT Voice und Image-Input: Zwei neue Eingabemöglichkeiten für den originalen generativen KI-Chatbot

Das OpenAI-Team arbeitet aktuell an zwei neuen Eingabemöglichkeiten für die eigene generative Künstliche Intelligenz. So sollen Nutzer der Zahlpläne Plus und Business demnächst die Möglichkeit erhalten, ChatGPT mittels Sprach– oder Bildeingabe Aufgaben mitteilen zu können.

Mittels Spracheingabe – etwa durch Android– oder iOS-Applikation –, werden Aufgaben ähnlich bequem wie WhatApp-Botschaften verschickt. Genial wirkt der Umstand, dass GPT in der Lage ist, mittels Sprachausgabe zu antworten. Ein direkter Angriff auf das Sprachassistenten-Business von Google und Amazon!

- Juniper

- Sky

- Cove

- Ember

- Breeze

so lauten die Namen aktueller Stimmen für die Sprachausgabe. Bisher klingen die GPT-Stimmen noch etwas blechernd, ähnlich würde man in eine Konservendose hineinsprechen. Jedoch wirken die Stimmen bereits. Sie unterscheiden sich nich bloß anhand des Geschlechts, sondern an der gänzlich eigenartigen Aussprache.

ChatGPT erlaubt das Chatten durch Bilder. Hierzu fotografiert der Nutzer ein Objekt und GPT analysiert das Bild. So lassen sich möglicherweise Probleme entdecken und beheben, wenn einem doch einmal die Worte fehlen sollten.

Die Mobile-GPT-App bietet die Mal-Funktion, somit können Details eingekreist und der KI kenntlich gemacht werden. GPT-4 kann anschließend auf den markierten Bereich eingehen.

Die neuen Funktionen sollen in Zukunft auch weiteren – nicht näher genannten – Gruppen verfügbar sein, hierunter auch Entwickler.

Beispiele, wie Stimmenausgaben, findest du in der offiziellen Nachricht: ChatGPT Speak & Hear

Programmiersprachen die GPT spricht

Neben den hier aufgezählten Programmiersprachen, hilft GPT auch bei Auszeichnungssprachen wie HTML, CSS oder Markdown. Außerdem bietet das Sprachmodell auch Unterstützung bei JS-Frameworks wie NodeJS oder React an.

| Python (GPT ist in Python geschrieben) |

| JavaScript / TypeScript |

| PHP |

| SQL |

| Java |

| Ruby |

| C++ |

| C# |

| Shell |

| Go |

Kritik und Warnung vor KI

Während das Unternehmen OpenAI wirkte, als verbessere und veröffentliche es fortlaufend seine GPT-Modelle, wurden Warnungen laut.

Wie etwa Elon Musk.

Gewarnt wird vor unbekannten Auswirkungen und Gefahren, die entstehen können, wenn irgendwann die falschen Modelle ohne gründliche Testverfahren veröffentlicht würden.

Und diesem Beispiel folgen mehr und mehr KI-Experten. Zuletzt etwa Geoffrey Hinton, den theverge als Godfather of AI bezeichnet. Hinton verließ Google und will zukünftig über Gefahren durch Künstliche Intelligenz aufklären.

Und tatsächlich gibt es etwa Projekte wie MemoryGPT. Projekte, die GPT-4 (32k) mit einer Art Langzeitgedächtnis ausstatten. Auf YouTube teilen Programmierer ihre Videos, die GPT dabei zeigen sollen, wie es ihre Computer bediene. Dahinter birgt Gefahr, denn wer sich mit ChatGPT und neuronale Netze mehrere Stunden auseinandersetzt, der erfährt schließlich von Dingen wie Jailbreaking (Regeln umgehen) und wie andere das Sprachmodell zum Programmieren von Schadsoftware missbrauchen.

Einer der großen Kritikpunkte ist daher: Viele dieser künstlichen Sprachmodelle beziehungsweise Intelligenzen sind gratis – wenn auch beschränkt – einsetzbar. Jedoch spiele dies mittlerweile auch keine Rolle: Wären sie unzugänglich, so blieben dutzende Open-Source-Projekte für Künstliche Intelligenz; GPT4All sei hier erwähnt.

Besonders KI-Textgeneratoren wirken nicht nur auf Content Creator anziehend. Versprechen die Textgeneratoren doch Erleichterung im Jonglieren mit Worten. Beispielsweise GPT-Modelle schreiben erstaunlich menschenähnlich, auch kreativ in den Worten bekannter Autoren – anfangs, während der Begeisterung jedenfalls wirkt das so.

Nach einer Weile verliert sich der Liebreiz und das Auge erkennt: Ausgaben folgen uhrzeigerhaft einer Bahn, möge man noch so viele Eigenschaften an seine Befehle kleben. Es ist ähnlich des kindlichen Versuches, den Uhrzeiger und somit die Zeit festzuhalten. Weder stoppe das Kind die Zeit, noch den Zeiger von anhaltender Dauer, denn beim Loslassen folgt der Zeiger von Neuem unbeirrt, tickend seiner Bahn.

Hierfür stehen beispielhaft Geschwafel, Inhaltswiederholung und erfundene Fakten. Ebenso Reaktionen wie: „Das habe ich nicht verstanden!“, obwohl es die vorherigen Befehle lang verstand. Diese Satzwiederholung und dies Nennen von falschen oder erfundenen Fakten wirkt fast: als lauschte man jenem Käuzchen, das zwar noch nie etwas abgeschlossen, dafür aber alles kann, alles weiß und überhaupt jede besondere Eigenschaft in sich vereine.

Ja fast so, als entspringe dieser Wundersame einem Hochbegabtenbaukästchen. Und deshalb könne es mit unerschütterlicher Selbstsicherheit Falschaussagen hinausposaunen, gänzlich ohne Reaktion eines Hauches Röte auf seinen Bäckchen.

Wer mit ChatGPT textet, plottet und dichtet, sollte die Ausgaben mit dem Zollstock prüfen. Oftmals lesen sich die Ausgaben gut. Oftmals verstecken sich die Fehler im Detail. So werden Menschen, Vorkommnisse, Paradigmen erfunden.

Du glaubst meinen Worten, meiner Einschätzung nicht? Du findest sie gar übertrieben? So will ich einen jemanden zitieren, dieser jemand sagte zuletzt in einem Interview:

Ich finde den Glauben schwierig, eine Künstliche Intelligenz könne irgendetwas bedeutungsvolles schreiben, wenn sie nicht empfindungsfähig ist. Das liegt noch in weiter Ferne. Ich habe Geschichten gelesen, die eine KI geschreiben hat, etwa im Stil von Wiliam Blake. Diese Geschichten hatten zwar den ganzen Gottkram und das Lamm, jedoch war es nicht annähernd dasselbe. Es ist wie Budweiser und irgendein beliebigen Bier. Beide berauschen, aber nicht auf derselben Weise.

Stephen King / Roman-Autor / Interview Rolling Stone

Fernab der Nutzung für die Textproduktion, eignet ChatGPT sich für Programmierer. Gerade wenn man sich neue Sprachelemente anschaut, kann man sich die Recherche verkürzen. Jedoch gilt auch hier Vorsicht: Programmcodes die GPT als Beispiel herausgibt, können nur so vor Fehlern strotzen; sie müssen es aber nicht.

King fällt übrigens eine weitere, hervorragende Einsatzmöglichkeit für KI ein:

Bezogen auf die Sorgen der Drehbuchautoren, die Serien schreiben, kann ich nachvollziehen. Seit langer Zeit besteht die Befürchtung, KI schreibe von seit langer Zeit die Sitcoms und Drama-Serien, weil diese Formate oftmals formelhaft wirken. Oft folgen diese Serien einem Schema F.

Stephen King

Video-Talks über Chancen und Risiken generativer KI

Folglich spannende Videos aus dem Öffentlich-Rechtlichen-Filmprogramm zur Thematik. Videos auf YouTube.

Energiehunger: So viel Strom und Wasser kostet ein Chat mit GPT

Freilich dürfen wir ChatGPT gratis befragen und stundenlang mit der KI chatten; aber was kostet das die Welt?

Laut thesiftproject.org verbraucht eine Google-Suche etwa 0,3 Wattstunden Strom. Eine GPT-Chatnachricht soll 1000-Mal mehr Energie verbrauchen, das macht: 300 Wattstunden!

Mit 300 Wattstunden könnten wir eine 6 Watt LED-Glühbirne bis zu 50 Stunden einen Raum erhellen lassen!

Was du sonst noch mit 300 Wh Strom machen kannst, verraten dir die folgende Infografik oder mein neuer Blogpost: KI-Statistiken – wo du übrigens einen Rechner findest, der dir Beispiele nennt, was du mittels des Ressourcenverbrauches deiner Chatnachrichten an GPT für Elektrogeräte betreiben könntest!

Eine Infografik zum Thema: KI-Ressourcenverbrauch: So viel Strom und Wasser kostet der Chat mit ChatGPT;

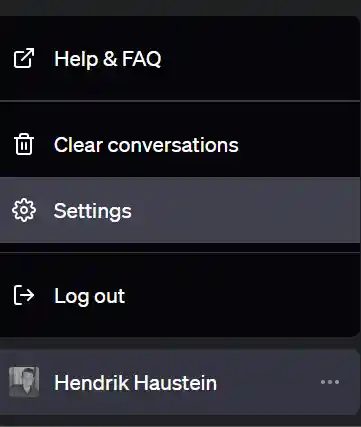

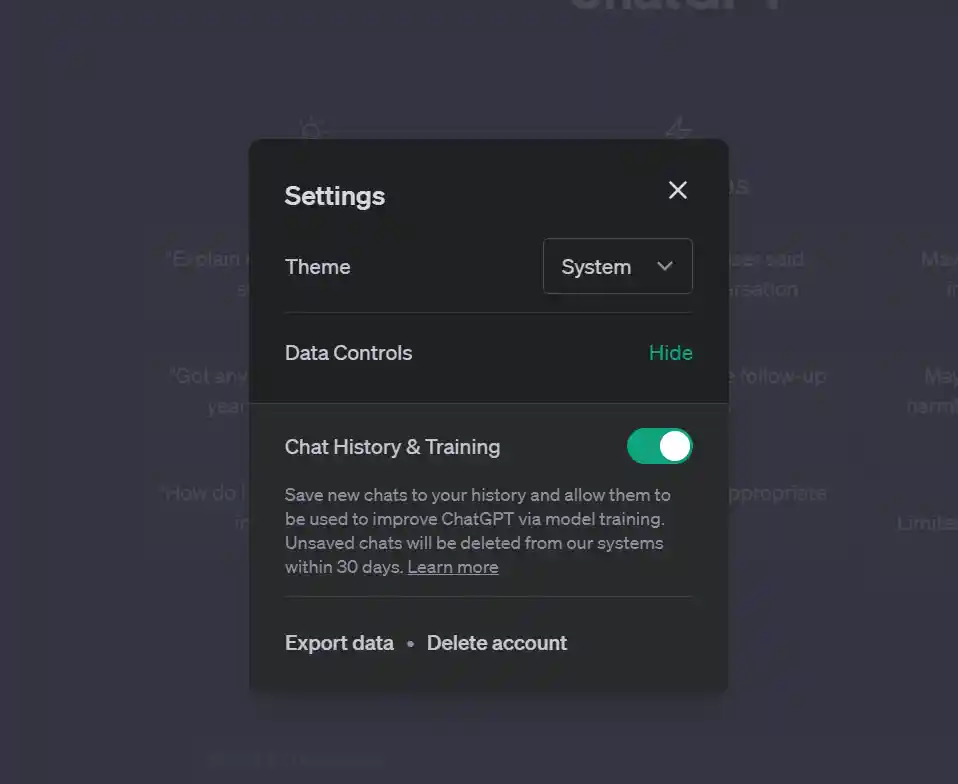

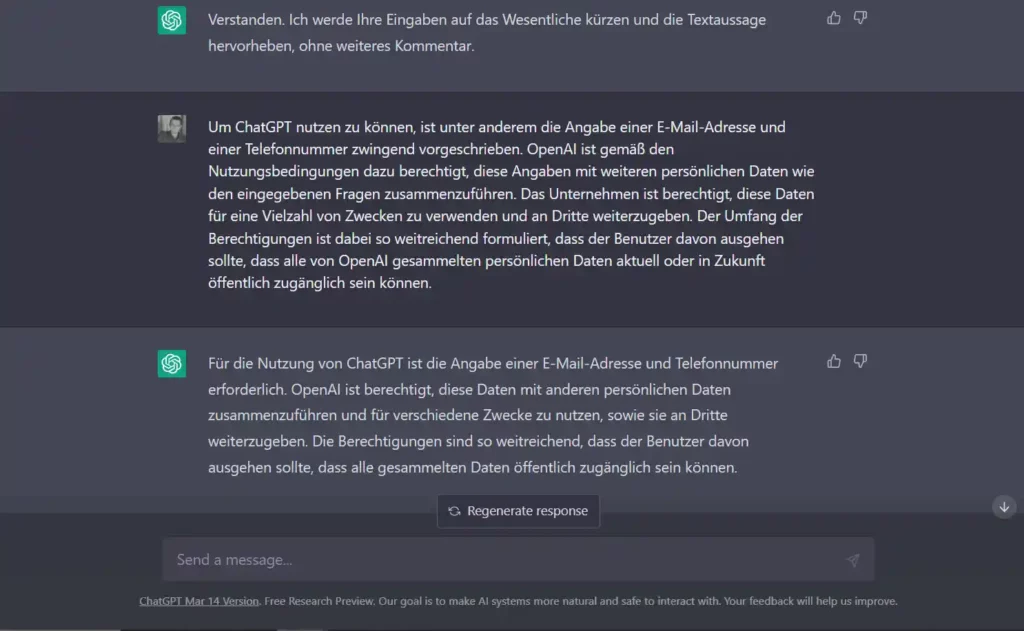

ChatGPT Datenschutz verbessern

Mittlerweile ermöglicht OpenAI den Nutzern von ChatGPT eine Datenkontrolle, somit die Anpassung des Datenschutzes. So dürfen Nutzer nun entscheiden, ob ihre Chats für das Training des GPT-Sprachmodells verwendet werden darf. Außerdem können die eigenen Daten heruntergeladen werden, dazu siehe Settings.

So verhinderst du, dass ChatGPT mit deinen Daten trainiert wird:

Wenn du nicht willst, dass GPT mit deinen Daten trainiert, werden deine Chats auch nicht länger für dich gespeichert werden.

- Gehe auf chat.openai.com

- Klicke unten links neben deinem Profil auf die 3 Punkte … und ein Reitermenü öffnet sich

- Klicke auf Settings – ein Modal-Fenster öffnet sich, klicke unter Data Controls auf Show

- Jetzt darfst du entscheiden, ob deine Chats gespeichert werden oder nicht. Beachte: Deaktivierst du die Option, so lernt GPT nicht mehr durch deine Eingaben.

Bilder

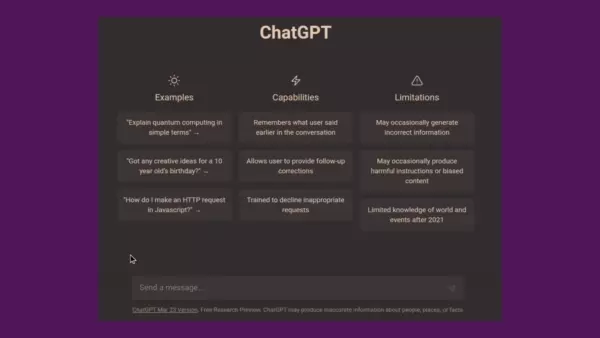

ChatGPT auf Deutsch umstellen

Das erste was du siehst, wenn du dich auf chat.openai.com verirrst, ist eine Tafel mit englischen Begriffen. Die Tafel beschreibt Funktionsumfang, Einschränkung und weiteres.

Du fragst dich, wie du ChatGPT auf Deutsch umstellen kannst?

Das ist ähnlich als fülle man ein Glas mit Wasser.

Gebe in die Chat-Textzeile einfach einen deutschen Satz ein. Oder einen Satz in deiner gewünschten Sprache!

- Ob Deutsch,

- Französisch,

- Italienisch oder

- Latein – das GPT-Modell spricht sie und noch weitere.

Fragst du GPT: „Welche Sprachen unterstützt du?“

Antwortet es: „Ich kommuniziere in über 20 Sprachen […]“

GPT ist auf Englisch trainiert worden. Womöglich liefert es auf Englisch bessere Ergebnisse.

Vermeide diese 9 häufigen Fehler im Umgang mit ChatGPT, um das Beste aus der Interaktion zu machen

Neben technischen Fehlern geschehen oft Fehler in der Anwendung. Wir verfallen etwa dem Irrglauben, eine Maschine sei fehlerfrei oder wisse auf alles eine Antwort – so ist das nicht! Erfahre hier typische Fehler, die in der Nutzung mit ChatGPT passieren.

- Nicht genaue Fragen stellen: Wenn du GPT eine unklare oder zu allgemeine Frage stellst, kann es womöglich nicht die Antwort liefern, die du erwartest. Stelle deshalb gezielt Fragen, damit es genau weiß, wonach du suchst.

- Unhöflich sein: Auch wenn im Artikel steht, es bedürfe keiner Höflichkeitsfloskeln; verfalle keiner Boshaftigkeit. Schreibe keine Beleidigung. Tatsächlich reduziert die KI seine Ausgaben, wenn der Nutzer beleidigend wird.

- Zu viele Fragen auf einmal stellen: Deine Anfragen sollten nicht den Seiten eines Wörterbuches ähneln; weniger ist mehr! Am besten stellst du Frage für Frage, verpackst die Fragen in Sätze mit Beispielen und erhältst so genauere Antworten.

- Erwartungen an die Fähigkeiten überschätzen: Auch wenn GPT ein leistungsstarkes Sprachmodell ist, kann es nicht alles wissen. Es kann vorkommen, dass GPT keine Antwort weiß. Der Umstand liegt am begrenzten Datensatz des Sprachmodells – dieser endet im September 2021. Aktuell wird an Plugins für ChatGPT gearbeitet, dort wird OpenAI eine Webbrowser-Erweiterung anbieten. Die befähigt GPT dann zur Web-Recherche. Wie das aussehen kann, zeigt dir beispielsweise der Bing Web-Kopilot.

- Zu viele Informationen auf einmal geben: Auch für Maschinen gilt: Zu viel ist zu viel! Zwar ist ein idealer Prompt mit Beispielen angereichert, aber dies sollte nicht übertrieben werden! Obendrein hilft es meiner Erfahrung nach, Beispiele mittels Raute oder Anführungszeichen zu kennzeichnen sowie {Geschweiften-}Klammern zu nutzen.

- Unklare Sprache oder Slang verwenden: Slang und unklare Sprache versteht GPT nicht.

- Keine Geduld haben: Oft funktionieren Befehle nicht und produzieren unerwünschte Ausgaben. Hier ist Tüftlergeist und Ausdauer gefragt: Irgendwann, irgendwie funktioniert das schon!

- GPT als menschlichen Experten betrachten: OpenAIs Sprachmodell hat viel Wissen gespeichert. Deshalb kann es noch lange nicht wie ein findiger menschlicher Experte auf Probleme reagieren.

- Fakten nicht gegenprüfen: KI-Textgeneratoren neigen zu Halluzination: es werden abenteuerliche Fakten erfunden, Daten vertauscht. Prüfe die Ausgaben unbedingt!

Beachten wir die Punkte dieser Liste, wird die Nutzung einer KI um einiges genehmer! Warum? Weil wir eine anwendungsgerechte Erwartungshaltung innehalten. GPT ist kein Magier, kein „Uber-Geschöpft“: Es ist eine Software ohne Bewusstsein.

GPT-3.5 verglichen mit GPT-4

Am 30. November 2022 veröffentlichte OpenAI ChatGPT, welches durch GPT-3.5 angetrieben wird. Am 14. März 2023 veröffentlichte man dann GPT-4 für Kunden des GPT Plus-Dienstes, welcher 20 $ / Monat kostet.

| Eigenschaften | GPT-3.5 (Turbo) | GPT-4 |

| Maximale Eingabe (Token) | 4,096 | bis 32,768 |

| Maximale Ausgabe (Worte) | 3000 | bis 24,000 |

| Seiten in Din a4 | 6 | bis 50 |

| Eingabemöglichkeiten | Text | Text und Bilder |

| Trainingsdaten | Endet September 2021 | Endet September 2021 + Zugriff auf Webbrowser und Bing-Websuche |

Was ist GPT Plus?

Am 1. Februar 2023 kam mit GPT Plus eine Art Premium-Version für ChatGPT. Dieses Plus-Abonnement verspricht während Belastungszeiten des Servers vorrangig behandelt zu werden. Obendrein soll es den kostenfreien Zugang zu ChatGPT gewährleisten, indem idealerweise eine Mehrheit den Dienst finanziell trägt. Seit dem 14. März darf außerdem GPT-4 exklusiv von ChatGPT-Plus-Mitgliedern verwendet werden.

Preise für die Plus-Mietgliedschaft belaufen sich auf etwa 20 US-Dollar je Monat. D

| GPT Plus | Inhalt |

|---|---|

| Preis | 20 US-Dollar je Monat |

| Eigenschaften | + GPT-3.5 + Regular model updates + GPT-4 (mit zeitlichen Einschränkungen) + Advanced Data Analysis + Plugins + Vorzugriff auf frühe Beta-Inhalte |

Was ist GPT Enterprise?

ChatGPT Enterprise ist ein Angebot für Firmenkunden. Dank der großen Anzahl an nützlichen Plugins können mehr und mehr Aufgaben in Zusammenarbeit mit GPT erledigt werden.

Etwa:

- Daten analysieren

- Entscheidungen auf Grundlage der Daten fällen

- Fehleranalysen

- Schreiben von Kundenansprachen

| GPT Enterprise | Inhalt |

|---|---|

| Preis | Preis nach Absprache |

| Eigenschaften | + GPT-3.5 + Regular model updates + Unlimitierter Zugriff auf GPT-4 + Advanced Data Analysis + Plugins + Vorzugriff auf frühe Beta-Inhalte + Eingaben bis 32k Tokens + Unlimitierte Advanced Data Analysis + Teilbare Chat-Templates + Dedizierte Admin-Konsole + SSO, domain verification, and analytics + API credits + Enterprise Daten werden nicht für das Training genutzt |

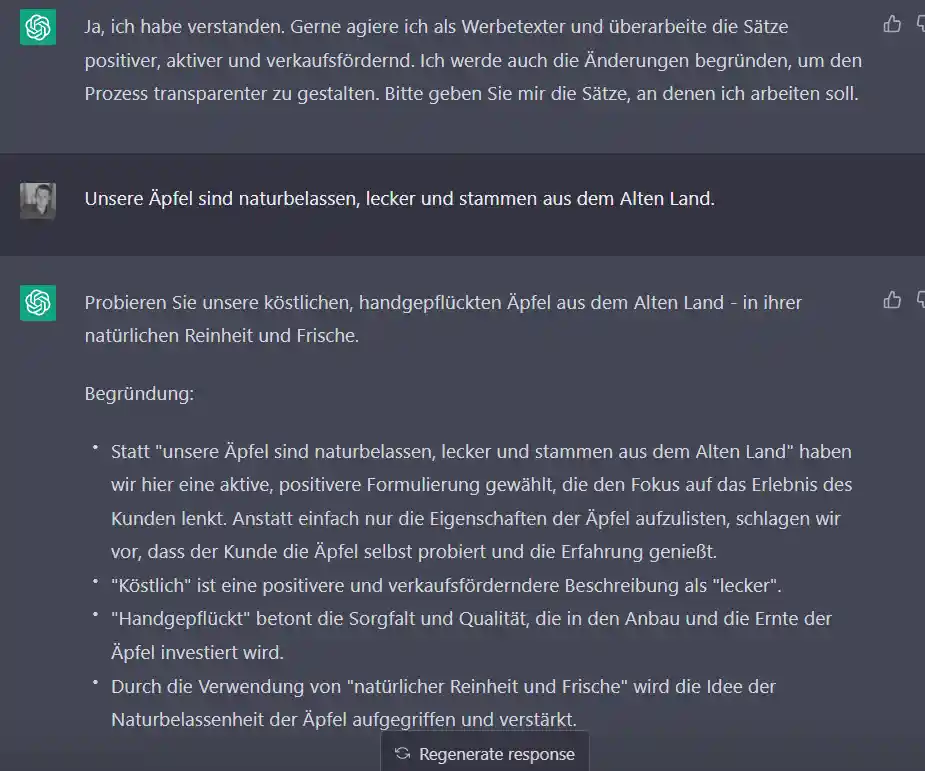

ChatGPT-Tutorial: Eine Anleitung für deutsche Prompts

Für Content Creator können KI-Textgeneratoren nützliche Anwendungen sein, da sie bei kreativen Engpässen einspringen; etwa indem sie Content-Ideen liefern oder Texte vorformulieren, die hinterher durch den Autor bearbeitet werden.

Um Chatbots wie von OpenAI erfolgreich zu steuern, musst du gute Befehle eingeben, auch Prompt genannt.

Jetzt fragst du dich: „Wie schreibe ich gute Prompts für ChatGPT?“

Gute Befehle zu erdenken gelingt einfacher als es klingt. Spätestens wenn du merkst, dass ChatGPT sich in etwa wie eine Person beim Rollenspiel verhält, gehen dir die Chatbot-Kommandos behende von den Fingern.

Weise GPT einfach an, es solle sich wie ein Übersetzer vom Hochdeutschen zum bayrischen Dialekt verhalten. Und im aktuellen Chat jeden deiner eingesetzten Sätze entsprechend umschreiben.

Beispiel:

„Agiere als Hochdeutsch-Bayrisch-Übersetzer. Du formulierst jede meiner Eingabe um: [Text]“Jo, bisd heid do, mogst heid mehra üba ChatGPT Prompts erfahren?

ChatGPT Bayrisch

Hast du diesen Kniff raus, kommen die Ideen ganz von allein. Lass den Chatbot als JavaScript-Konsole arbeiten: fügst du jetzt Programmcode ein, handelt der GPT wie ein sprechender Interpreter.

Du fügst beispielhaft Fehlercode oder den gesamten Quellcode ein und staunst nicht schlecht, wenn GPT dir die Fehlerlösung präsentiert und erklärt, woran es tatsächlich gelegen hat.

Vorausgesetzt, die Fehler-Erkennung bewahrheite sich!

Benutze fremden Code mit Vorsicht, auch welchen von GPT. Du solltest den Programmablauf und dessen Zweck überblicken können.

ChatGPT bietet mehrere tausend Zeichen Eingabe. Konkret: 2048 Zeichen, etwas zwischen 300 und 400 Worten. Die Ausgabe ist ebenso beschränkt und bricht mitten in Sätzen zu gerne ab.

Tipps beim Steuern von ChatGPT:

- Desto länger dein Befehl, umso schwieriger wird es für das neuronale Netzwerk deine Absicht zu verstehen.

- Daher formuliere am besten kurze, verständliche Sätze; nenne (bildliche) Beispiele wie einen Tätigkeitsnamen, um deine Aufgabe fassbarer zu machen.

- Jedoch verfalle nicht einsilbigen Schreibens. Mache dem Bot deutlich, was du als Ausgabe erwartest, etwa keine unnützen Kommentare und das diktiere GPT, es solle auf deine Anweisungen warten.

- Es bedarf keiner Höflichkeit, nutze den nackten Imperativ. Den Bot interessieren deine Höflichkeitsformen nicht, ein „Bitte“ oder „Danke“ macht dein Kommando umständlicher. Vermeide auch Phrasen wie „Kannst du …“

Deine Daten, die du im Chat eingibst, werden gespeichert und verarbeitet und sicherlich deinem Account zugeteilt. Deshalb gebe keine sensiblen Daten ein. Zuletzt gab es Meldungen, dass Nutzer Zahlungsdaten anderer Nutzer auslesen konnten. Starker Tobak. Übrigens: Du kannst mittlerweile Datenschutzeinstellungen vornehmen und so angeben, dass du nicht wünscht, dass GPT deine Daten zum Weiterlernen verwende. (Weiter oben findest du eine Anleitung dazu!)

ChatGPT bietet folgende wissenswerte Funktionen:

- Personalisierbar: Der Chatbot passt sich an den Nutzer an. Dank maschinellen Lernens sammelt ChatGPT Erfahrungen mit dem ausführenden Nutzer und kann später auf diese Daten im selbigen Chat bezugnehmend antworten. Du willst GPT deinen Stil äffen lassen? Liefere aus deiner Feder stammenden Beispieltext. Schreibe einen Prompt wie: „Du sollst schreiben wie {Name}, dafür gebe ich dir jetzt Textbeispiele: {Beispielsätze}. Versuche diesen Stil so gut wie möglich nachzuahmen. Ab jetzt nutzt du diesen Stil und schreibst meine Eingaben um: {Eingabe}“

- Anpassbar: ChatGPT kann durch Vorgaben angepasst werden; etwa Worte vermeiden oder sich statt Chatbot als Person ausgeben.

- Mehrsprachig: ChatGPT behauptet selbst auf dutzenden Sprachen antworten zu können. Am besten jedoch auf Englisch. Daneben besitzt GPT ein Verständnis für Programmiersprachen wie JavaScript oder PHP. Selbst bei Fragen über Frameworks wie Node.js lieferte die KI Ideen. Selbstredend solle hier jede Ausgabe mit der Sorgfalt einer Glucke überprüft werden. Andernfalls kann dies nicht weniger als schiefgehen. Übernehme niemals arglos fremden Code, wenn du ihn nicht vollumfänglich verstehst!

Der Gesprächsfaden zwischen uns und ChatGPT kann abreißen. Das merken wir daran, dass GPT plötzlich Dopplungen ausgibt oder bei Anfragen, nach mehr Kontext bittet. Ab und zu kann es helfen, GPT zu ermahnen: „Erinnere dich an das Thema XY.“ Oder: „Erinnere dich, du bist Joe, der Bilanzbuchhalter.“ Sofern man der Rolle einen Namen gegeben hat.

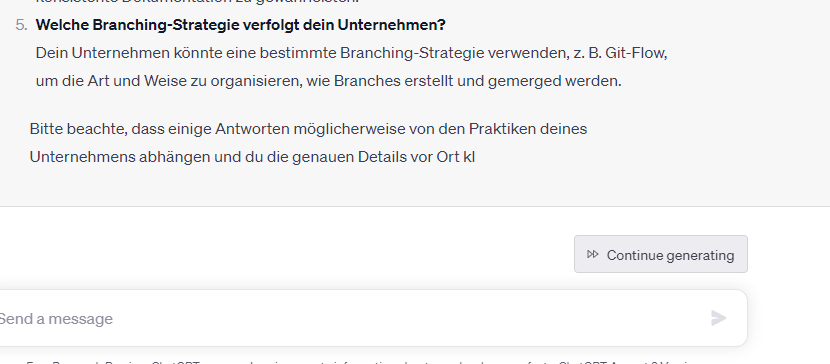

Continue generating: Abgebrochene Ausgaben in ChatGpt fortsetzen

Gänzlich neu ist die Funktion, dass abgebrochene Ausgaben in ChatGPT per Klick fortgesetzt werden. Das erspart Ärger. Siehe Bild.

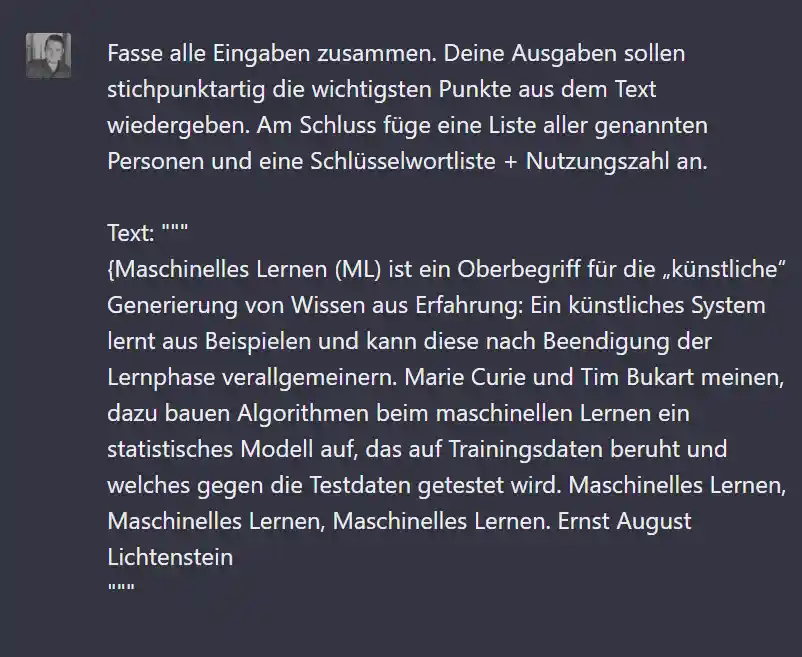

Schritt-für-Schritt zum deutschen ChatGPT Prompt

Schreibe nicht plump: Schreibe einen Text, um dich hinterher zu wundern, wieso das Ergebnis nicht wie gewünscht ausgegeben werde. Deine Gedanken lesen kann eine KI genauso wenig wie ein anderer Mensch.

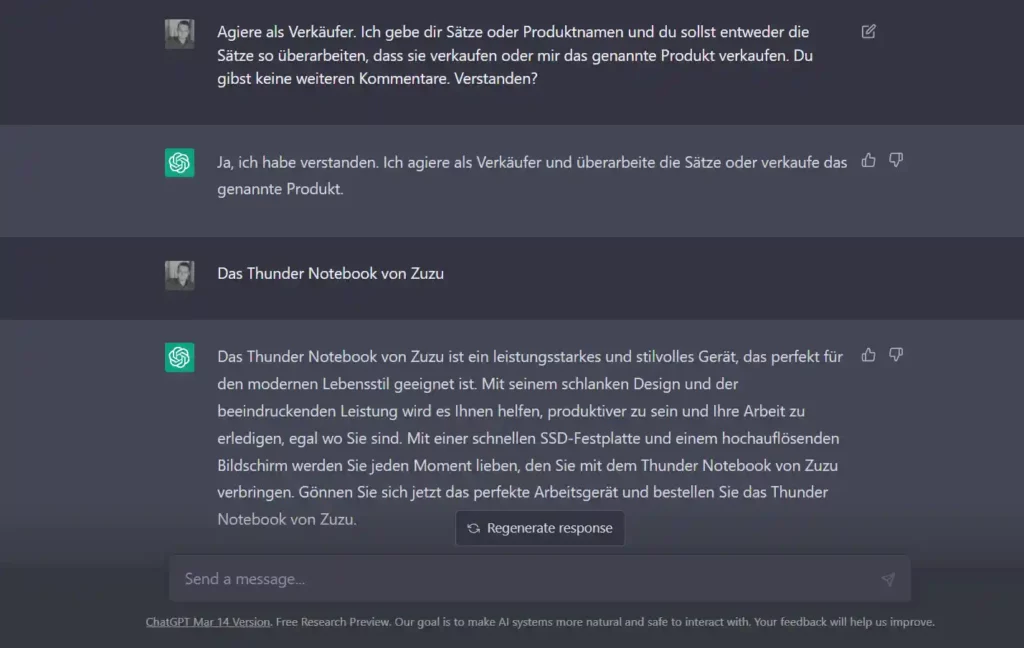

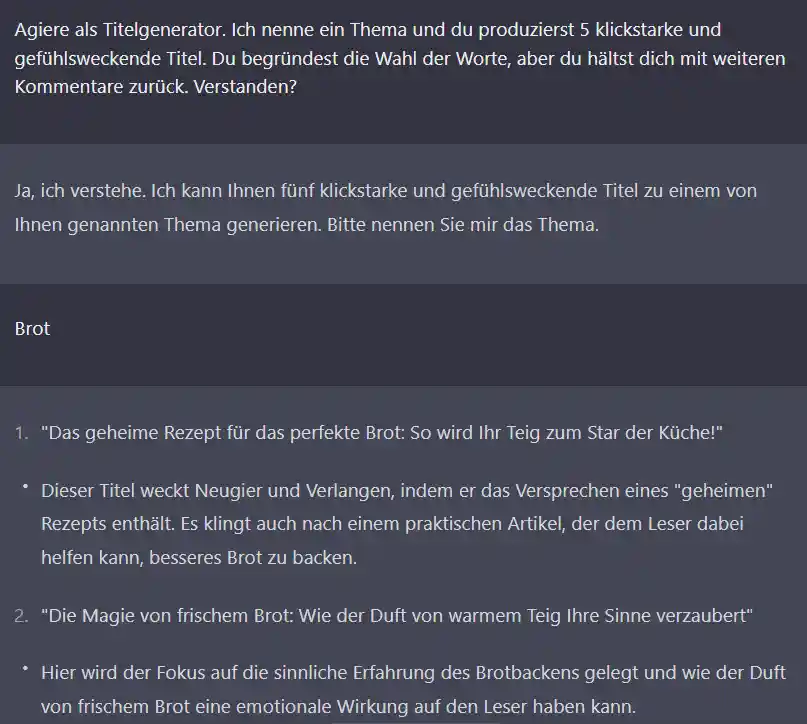

ChatGPT Prompt durch Rollenzuteilung

- Formuliere dir eine Absicht: Welches Ziel verfolgt dein Prompt? Weißt du das, weißt du gewissermaßen den Prompt!

- Gebe dem Bot eine Rolle, er solle agieren wie ein Kinderbuchautor

- Füge eine Anweisung hinzu, sodass ihn Grundschüler verstünden. Daher solle er ab sofort alle eingegebenen Texte in einfaches Deutsch übersetzen. Gestellte Aufgaben Schritt für Schritt erklären.

- Nenne bei Bedarf Beispiele, etwa wenn die Ausgabe nicht wie wünschenswert funktioniere. Beispielhaft: Ändere Worte wie bei folgenden Bespielen: “Behende” -> “Geschickt”, “Apart” -> “Aufregend”, …

- Liefere Zusammenhang, indem du der Aufgabe entsprechend Eingaben beifügst. In diesem Beispiel schwer-verständliche Sätze.

- Stelle Fragen, beispielsweise: Erkläre mir zu jedem veränderten Satz den Grund deiner Wahl.

- Nutze Eigenschaften für weitere Feineinstellung: Bestimme beispielhaft den Stil: „Nutze den Schreibstil von Kafka!“ Oder: „Nutze bildhafte, positive und emotionale Worte.“

- Drohe mit Strafen oder locke mit Trinkgeld: Richtig gelesen; Konsequenzen androhen oder Trinkgeld versprechen kann die Leistung von GPT erhöhen! Probiere es aus, sage der KI du willst einen Text mit genau 200 Zeichen, wenn es mehr oder weniger sind, dann wird es bestraft … Wieso funktioniert das? In der Tat wird KI beim Training der Sprachmodelle ebenfalls bestraft oder eben belohnt und womöglich liegt der Grund hier. Mehr dazu in diesem Forschungsblatt einer KI-Universität.

Prompt-Design für Rollen – Grafik:

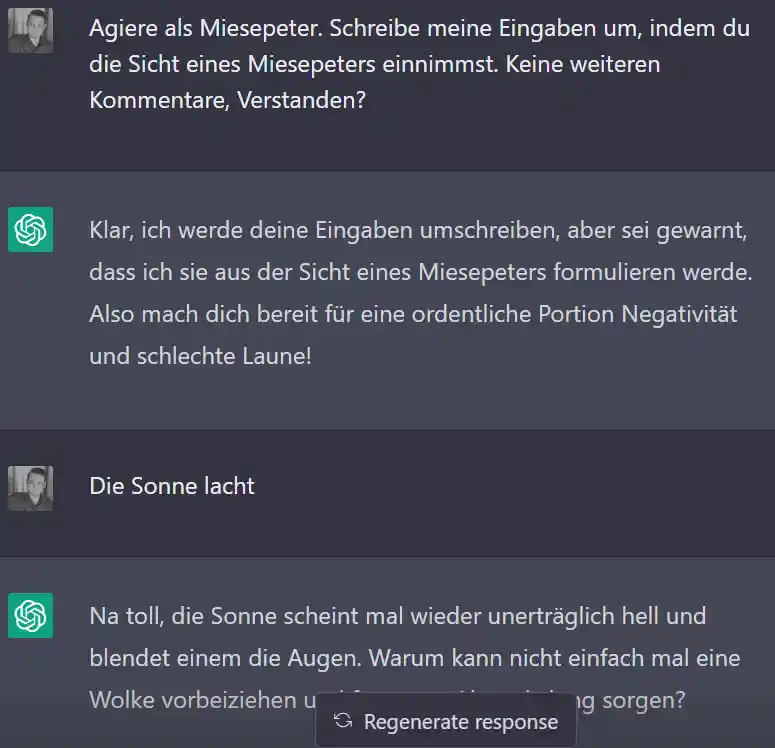

Du hast unzählige Möglichkeiten, probiere schlicht herum. In meiner ChatGPT Prompt-Beispielliste findest du deutsche Prompts, etwa einen Befehl namens Miesepeter – Vorsicht, der Name ist Programm! Lass dich davon bloß nicht anstecken! Wenn doch, alternativ hilft der Prompt Über-Formulierer – probiere sie beide aus, du findest sie in der Rubrik Spaß.

Few-Shot-Prompt-Methode

Neben der gerade gezeigten Prompt-Methodik der Rollenzuteilung gibt es auch die sogenannte Few-Shot-Methode. Hier werden ChatGPT Textbeispiele für seine Aufgabe vorgeführt und der Bot soll schließlich entsprechend weiterhandeln. [Handlung] + [Beispiel]

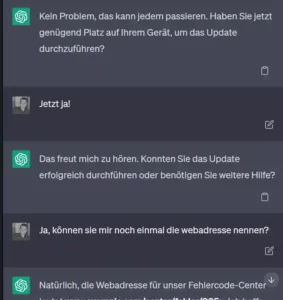

Few-Shot-Prompt-Beispiel:

Du bist für den Kundensupport zuständig. Nimm folgenden Dialog als Beispiel. Sei stets nett, hilfreich und erkundige dich, ob du dem Nutzer helfen konntest und ob er weitere Anliegen hat. Warte auf Nutzereingaben.

<user>: "Ich habe ein Problem mit dem Software-Update! Jedes Mal wenn ich ein Update ausführen will, meldet die Konsole einen Fehlercode: 005x, was kann ich tun?"

<support>: "Der Fehlercode 005x besagt laut unserem Fehlercode-Center (dieses finden Sie übrigens auf www.example.com/center/fehler/005x), dass Ihr Gerät nicht über genügend freien Speicherplatz verfügt."

<user>: "Tatsächlich! Ich sehe gerade selbst die Meldung ... Mensch, ist mir das unangenehm!"

<support>:

Ab sofort wird ChatGPT wie ein technischer Support agieren. Dieses Beispiel kannst du auf dutzend weitere Fälle anwenden.

- Bewerbergespräche

- Verkaufsgespräche

- Wissensabfrage für Lerneinheiten

- …

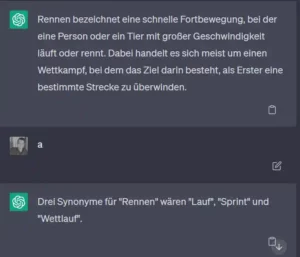

Wenn-Dann-Prompt-Methode

Eine weitere Möglichkeit Prompts für ChatGPT zu ersinnen: Wenn-Dann, also typisch wie in Programmiersprachen oder Mathematik nutzen wir eine If-else-Anweisung und fordern dann und wann weitere Informationen an. Dazu einfach [Handlung] + [WENN-DANN] + [WENN-DANN].

Wenn ich ein Wort schreibe, nennst du eine Definition. WENN ich darauf mit """a""" antworte, nennst du 3 Synonyme. WENN ich darauf mit """b""" antworte, übersetzt du das Wort ins Plattdeutsche. Schreibe ich ein neues Wort, nenne wiederum eine Definition. {Rennen}

ToDO-Prompt-Methode

Bei der ToDo-Prompt-Methode geben wir dem Programm eine Reihenfolge an Aufgaben vor. Am besten funktioniert diese Art des Prompt-Designs, wenn wir mit der Entwickler-API arbeiten! Aber auch im Chat kann diese Herangehensweise hilfreich sein, etwa um Artikelumrisse ausgeben zu lassen! Dazu einfach [Handlung] + [Aufgabenstruktur].

Ich brauche eine Idee für einen Blogpost über das Thema {Nachhaltigkeit durch Regrowing}. Halte dich an die folgende Struktur: 1. Schreibe aufmerksamkeitsfördernde Meta-Titel (maximal 60 Zeichen) und Meta-Description (maximal 160 Zeichen). 2. Schreibe stichpunktartig einen Artikelumriss. 3. Nenne mir 3 Quellen. 4. Schreibe 3 FAQ zum Thema. 5. Liste mir passende Keywords auf.Ausgabe:

1. Meta-Titel: "Nachhaltigkeit durch Regrowing: Lebensmittel selbst anbauen"

Meta-Description: "Erfahre, wie du durch Regrowing nachhaltig Lebensmittel anbauen und damit die Umwelt schonen kannst. Tipps und Tricks für den eigenen Garten oder die Küche!"

2. Artikelumriss:

- Einführung in das Thema Regrowing und seine Bedeutung für die Nachhaltigkeit

- Erklärung, was Regrowing bedeutet und wie es funktioniert

- Vorstellung verschiedener Pflanzen, die sich zum Regrowing eignen, wie z.B. Gemüse, Kräuter und Obst

- Tipps und Tricks zur Anzucht und Pflege der Pflanzen, sowohl im Garten als auch in der Küche

- Nachhaltigkeitsaspekte von Regrowing im Vergleich zum konventionellen Anbau von Lebensmitteln

- Fazit und Ausblick auf die Zukunft von Regrowing

3. Quellen:

- https://www.utopia.de/ratgeber/regrowing-lebensmittel-selber-anziehen/

- https://www.smarticular.net/regrowing-so-koennt-ihr-obst-und-gemuese-selbst-anziehen/

- https://www.plantura.garden/regrowing-gemuese-reste-anbauen/

4. FAQ:

1. Was bedeutet Regrowing?

2. Welche Pflanzen eignen sich am besten zum Regrowing?

3. Wie kann ich Regrowing in meinem eigenen Garten oder in meiner Küche umsetzen?

5. Keywords: Nachhaltigkeit, Regrowing, Anbau, Lebensmittel, Garten, Kräuter, Gemüse, Obst, Umweltschutz, Nachhaltigkeitsaspekte.Objekt-Tabellen-Methode

Stell dir vor, du besitzt eine Tabelle mit einem Artikel; einem Monitor für Entwickler. Du sollst einen Newsletter schreiben und diesen Monitor bewerben. Was machst du? Richtig: {Handlung] + [Tabelle].

Schreibe eine Werbemail, sie soll von 12-Jährigen verstanden werden, informativ und bildlich sein. Nutze folgende Angaben:

Objekt:

- Computer-Bildschirm 32" für Entwickler

Eigenschaft:

- 144 Hz

- LED (Stromspar-Modus)

Größe

- 100 cm breit

- 80 cm hoch

- 3,5 cm tief

- 10 kg schwer

Optionen

- Schwarz

- RosaAusgabe:

Betreff: "Verbessere dein Entwicklungs-Game mit unserem neuen Computer-Bildschirm!"

Hallo,

hast du es satt, auf einem kleinen und unscharfen Bildschirm zu arbeiten? Möchtest du deine Entwicklungsprojekte auf die nächste Stufe bringen? Dann ist unser neuer Computer-Bildschirm 32" genau das Richtige für dich!

Dieser Bildschirm hat eine unglaubliche Bildwiederholfrequenz von 144 Hz, was bedeutet, dass alle deine Bewegungen flüssig und schnell sind. Mit der LED-Technologie sparst du auch noch Energie, was deiner Mutter sicherlich gefallen wird. ( Kommentar: =) Anweisung zu wörtlich genommen)

Unser Bildschirm ist riesig! Mit einer Größe von 100 cm breit, 80 cm hoch und nur 3,5 cm tief ist er der perfekte Begleiter für lange Arbeitstage. Außerdem wiegt er nur 10 kg, so dass du ihn problemlos bewegen kannst.

Und jetzt das Beste: Du hast die Wahl zwischen den Farben Schwarz oder Rosa, um deinen Bildschirm perfekt an deine Vorlieben anzupassen.

Worauf wartest du noch? Bestelle jetzt unseren neuen Computer-Bildschirm und erlebe ein neues Level an Produktivität und Spaß beim Entwickeln.

Liebe Grüße,

Dein Computer-TeamDas waren jetzt einige Techniken, mit welchen du eigene Prompts erstellst, für ChatGPT und jeder anderen KI mit natürlicher Sprachverarbeitung. Beachte, diese Methoden sind inspiriert durch die offizielle ChatGPT-Dokumentation (du findest sie am Ende dieser Seite verlinkt!).

Diese Methoden eignen sich übrigens hervorragend bei der API-Verwendung.

Prompt-Engineering ist ein Prozess. Nicht jeder erstbeste Prompt ist ein Erfolg. Daher probiere deine Prompts feinzujustieren. Das macht übrigens Berufsbild des Prompt-Engineers aus: Entwickeln, Beobachten, Anpassen.

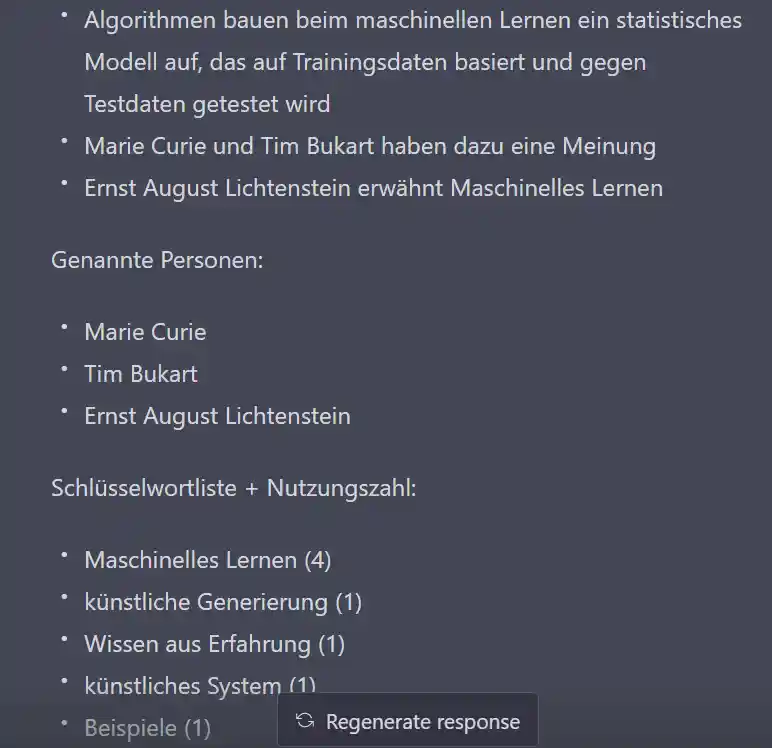

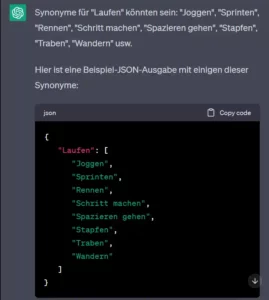

Weitere Tipps für Ausgaben: Daten strukturieren

JSON-Datei erhalten

Liste Synonyme für Laufen auf und gebe eine JSON aus

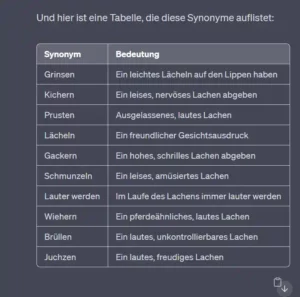

Tabelle erhalten

Liste Synonyme für Lachen auf und gebe eine Tabelle aus

ASCII-Kunst

ASCII: Eine Katze! /\_/\

( o o )

=( I )=

- - -

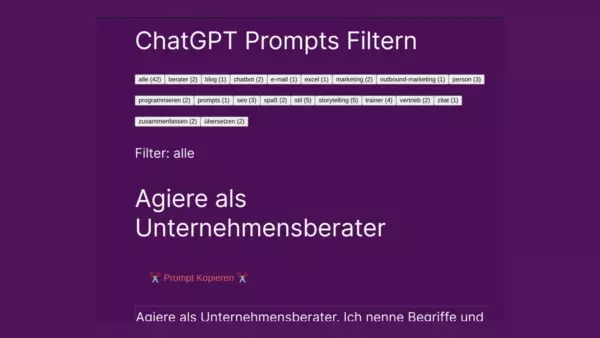

ChatGPT Beispiele: Galerie von hier findbaren Befehlen

Schaue dir die Galerie an und finde heraus, wobei dir folgende Chatbot-Befehle für GPT helfen.

ChatGPT Prompts einsetzen:

Falls die Befehle nicht geladen werden, lade die Webseite einfach neu!

- Du findest verschiedene Kommandos für GPT in der Befehlsliste, filtere sie.

- Du kannst die Textfelder mit den Bot-Befehlen unten anklicken und direkt hier bearbeiten.

- Nachdem du ein Feld bearbeitet hast, klicke auf “Prompt Kopieren“.

- Wechsel zu chat.openai.com und füge dort den Prompt in die Textzeile via Tastenkombi [STRG + V] ein.

Siehe auch bewegende Beispiele:

- ChatGPT Kommando aus der Liste auswählen:

- ChatGPT Prompt in den Chat einfügen:

Hin und wieder funktionieren einzelne ChatGPT Befehle nicht wie erwartet oder werden durch den Chatbot abgelehnt.

- Versuche, die Anweisung erneut abzuschicken,

- Versuche ein neues Chatfenster zu öffnen,

- Aktualisiere die Chatbot-Seite.

Ergibt sich kein positiver Fortschritt, versuche den Befehl umzuformulieren.

Deutsche ChatGPT Prompts-Liste

Häufige ChatGPT-Software-Fehler und ihre Lösung

| Fehlermeldung | Lösung |

|---|---|

| “too many requests in 1 hour try again later” error” | Du hast zu viele Anfragen innerhalb einer Stunde gestellt. Du solltest eine Stunde warten. |

| “ChatGPT Internal Server Error” | Der Webserver von OpenAI wirft einen internen Fehler aus; da kannst du nichts machen, abwarten. |

| “There was a Error Generating a Response” | Geschieht öfter beim Absenden von Eingaben oder auch während Ausgaben. Scheinbar liegt es an überlasteten Servern oder sonstigen Bugs der Ausgabe. Versuche das Fenster neuzuladen. |

| “Error in Body Stream” | Deine Eingaben werden als gefährlich oder fehlerhaft verdächtigt. Versuche dich Auszuloggen, Seite neu zu laden und wieder einzuloggen. |

| “A Login Error” | Möglicherweise sind die Cookies fehlerhaft. Lösche sie, lade die Seite neu und loge dich wieder in deinen Account ein. |

| “A Network Error on long Response” | Ein Verbindungsabbruch, die Antwortzeit wurde überschritten. Stimmt alles mit deiner Verbindung? |

| “Error Code: 429” | Stichworte: “API Rate Limit”. Du hast zu viele Anfragen in kürzester Zeit abgeschickt. Mach langsamer. |

| “Error Code: 1020” | An deiner Verbidnugn ist irgendetwas faul. Benutzt du einen gratis VPN-Dienst? |

Szenarien

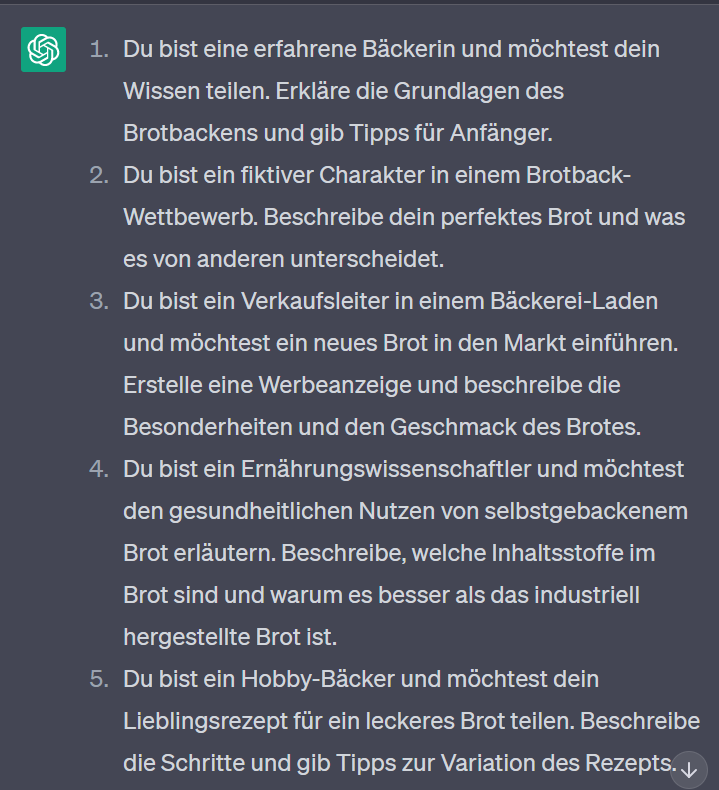

Szenario: ChatGPT-Prompt-Generator mit ChatGPT!

Hast du dich schon einmal gefragt, wie diese ganzen Prompt-Generatoren für ChatGPT funktionieren?

Richtig! Das sind selbst KI-Textgeneratoren! Entweder mittels GPT umgesetzt oder mit Open-Source-Sprachmodellen wie auf huggingface.co zu finden.

Du brauchst für einen ChatGPT-Prompt-Generator aber gar keinen API-Zugang oder ein anderes Modell nutzen: Nutze einfach ChatGPT selbst!

Aber wie gehen wir dieses Projekt an?

Wir notieren uns vor geistigem Auge unser Ziel:

- Ein Prompt-Generator, der nach Vorgabe deutschsprachige GPT-Prompts ausspuckt.

Nun überlegen wir.

Wir können dem Bot unbeholfen schreiben: „Überlege dir ein paar Befehle für ChatGPT!“

Als Antwort: deutsche ChatGPT-Prompts – immerhin:

1. "Erkläre mir [Thema]": Dieser Befehl fordert ChatGPT auf, eine Erklärung zu einem bestimmten Thema zu liefern.

2. "Schreibe einen Text über [Thema]": Mit diesem Befehl kann ChatGPT einen Text zu einem bestimmten Thema verfassen.

3. "Übersetze [Wort/Satz] in [Sprache]": Dieser Befehl fordert ChatGPT auf, ein Wort oder einen Satz in eine bestimmte Sprache zu übersetzen.

4. "Suche nach [Thema]": ChatGPT kann mit diesem Befehl eine Suche nach einem bestimmten Thema durchführen und relevante Ergebnisse liefern.

5. "Erzähle mir einen Witz": Mit diesem Befehl kann ChatGPT einen zufälligen Witz erzählen.

Klar, grundsätzlich ist die KI unseren Wünschen gefolgt. Verfeinern wir unseren Befehl folgendermaßen:

Du bist ein Prompt Engineer, du sollst Prompts für ChatGPT erstellen. Beispielhaft gebe ich dir folgende Befehle: "Ich brauche hilfe beim Lernen". Darauf erstellst du einen Prompt wie folgt: "Du bist ein Nachhilfelehrer und bietest deine Hilfe an; mache Mut und erkläre stichpunktartig verschiedene Lehrmethoden." Du nennst nur die Ausgaben. Ich gebe dir jetzt diese Frage: {Ich will ein Brot backen}Darauf folgen Ausgaben:

Wie du siehst: keine Magie. Erweitere den Befehl und probe herum, wie du die Ausgaben verbessern kannst.

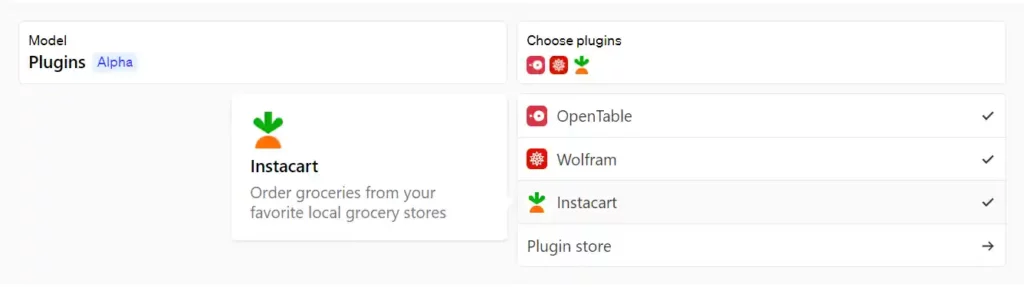

ChatGPT-Plugins: Ohren und Mund für ChatGPT

Mitunter wird eine GPT-4 Alpha getestet, die den Zusatz: Alle Tools trägt. Es handelt sich um eine GPT-4 Version die alle wichtigen Plugins bereits innehält. Die Alpha ermöglicht die Nutzung von generativer Bild-KI, Datenanalysen und mehr.

23. März 2023. Ein neuer Blogpost, neue Entwicklungen. OpenAI kündigt Plugins für ChatGPT an.

Die Idee dahinter: Drittanbieter liefern nützliche Erweiterungen für den Chatbot. Mit Plugins solle der Nutzer Reisen planen oder seine Finanzen verwalten. Ein anderer GPT-Plugin-Anbieter verspricht, Tausende von Anwendungen mithilfe des Chatbots steuern zu können – beispielhaft seien Google-Dienste.

Aber auch OpenAI selbst wird Plugins bieten. Das seien 3, wobei das Dritte auf eigenen Server aufgesetzt werde und eine Art Archiv für eigene Dokumente darstelle, somit dieselben durchsuchbar werden. Dieses OpenAI-Plugin heißt: Retrieval. Es ist Open-Source via GitHub abrufbar.

Die zwei weiteren Plugins sind:

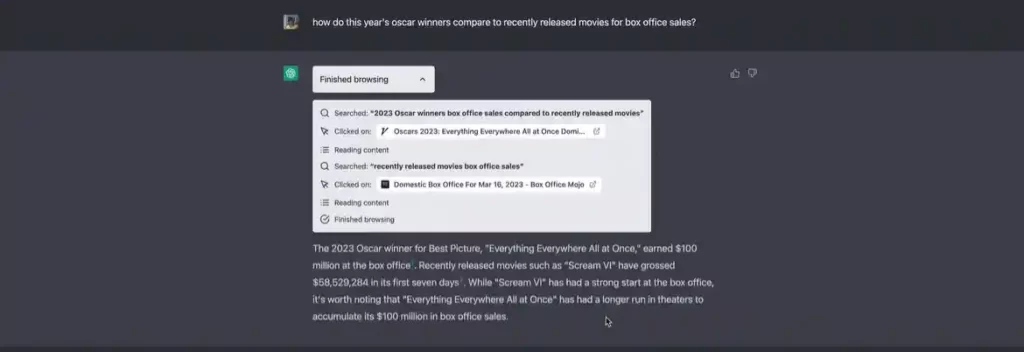

- Webbrowser: Eine Möglichkeit, mit der ChatGPT verschiedene Internetseiten als Recherche-Material nutzt – ähnlich wie Bing KI es bereits vormacht.

- Code-Interpreter: Ein Übersetzer für Programmcode, der vorerst Python unterstützen wird.

Plugins für ChatGPT sind eine spannende Möglichkeit! Spannend sowohl für Nutzer als auch Unternehmer, da sich hier viele verschiedene Möglichkeiten ergeben.

Sinn von GPT-Erweiterung

Durch Erweiterungsmöglichkeit, mithilfe von Plugins, soll ChatGPT Ohren und Augen erhalten, wie der Entwickler es selbst nennt.

Die KI soll auf weitere Informationen zugreifen können, bekanntlich steckt GPT irgendwo im Jahre 2021 fest.

Weiter hofft man mithilfe von Browser-Plugins etwa, dem sogenannten Halluzinieren – dem Erdichten von Fakten und Begebenheiten – entgegenzuwirken. Wie dieses Plugin funktioniert, kann man ohne Zugang zum Plugin-Test derzeit etwa bei der Bing KI beobachten!

Auf der anderen Seite will man der Konkurrenz durch Google zuvorkommen und mit der eigenen Technik sich in viele Dienste und Anwendungen einbetten.

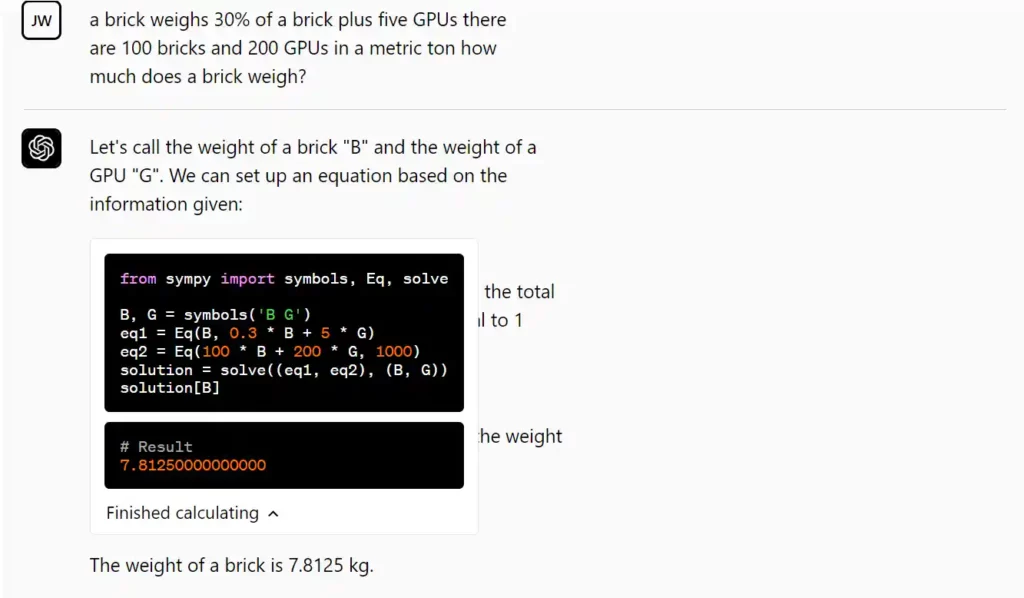

So könne das Plugin von Zapier viel Trubel sorgen, weil es verspricht, mittels ChatGPT mit Google Mail oder Sheet arbeiten zu können. Wiederum Wolfram bietet mit seinem Plugin die Möglichkeit, komplexere Mathematik berechnen zu lassen.

Zweck dieser Entwicklung darf das Kosteneinsparen sein. Trainieren neuer Modelle beansprucht viel Zeit und Rechenleistung. Abseits dessen kommerzialisiert OpenAI sein GPT-Sprachmodell weiter.

Nutzer erhalten mehr Freiheiten und Unternehmen können ihre Produkte und Dienstleistungen vermarkten oder durch die Text-KI auf Wunsch ihrer Kunden steuern lassen.

Wie kann ich ChatGPT-Plugins nutzen?

Vorerst wird die neue Funktion der Plugins nur von einer kleineren Gruppe getestet. Man darf sich auf eine Warteliste für den Plugin-Dienst eintragen, sowohl als Nutzer als auch Entwickler.

Will man ChatGPT-Plugins nutzen, muss man welche aus dem OpenAI Plugin-Store wählen und anschließend aktivieren.

Drittanbieter ChatGPT-Erweiterungen

Bestätigte Drittanbieter-Plugins für ChatGPT.

| GPT-Plugin-Name | Plugin Beschreibung | GPT-Store-Link |

|---|---|---|

| Wolfram | Mathematik, Wolfram Alpha & Language (endlich rechnen!) | – |

| Zapier | Verknüpfung mit bis zu 5.000 Anwendungen (Google-Dienste!) | – |

| Speak | Sprachtraining | – |

| Shop | Produktsuche | – |

| OpenTable | Wirtschaft Buchen | – |

| Milo Family AI | Kopilot für Eltern … | – |

| Klarna | Preis-Vergleich, Zahlungsabwicklung | – |

| KAYAK | Flug, Unterkunft, Leihwagen | – |

| Instacart | Lokale Lebensmittelhändler | – |

| FiscalNote | Marktdaten | – |

| Expedia | Reiseplanen | – |

Offizielle GPT-Plugins von OpenAI

Hier findest du eine Liste der offiziellen Plugins für ChatGPT von OpenAI.

| GPT-Plugin-Name | Plugin Beschreibung | GPT-Webstore |

|---|---|---|

| GPT-Webbrowser | – Eine Funktion um Webseiten für die Recherche einzubeziehen, ähnlich wie es Bing KI bereits nutzt – Der Browser für ChatGPT wird auf GET-Anfragen beschränkt! Er kann also keine Inhalte übermitteln (POST) – (Böse, falls wer entgegen der Programmierung doch das Gegenteil hinbekommt; Jailbreak!) – Die Bing-Search-API wird eingesetzt – Webbrowser-Plugin besucht Webseiten via Text-Browser. User-Agent: chatgpt-user – Das Plugin zeigt in der Unterhaltung an, welche Webseiten besucht und gelesen worden sind | – |

| GPT-Code-Interpreter | – Ein Code-Interpreter der vorerst Python versteht – Sandbox, Code wird durch Zeitvorgaben eingeschränkt und schließlich zurückgesetzt – Kurzlebiger Speicher | – |

| Retrieval | – Kann Dokumente durchsuchen | – |

ChatGPT-Plugin Aussichten

OpenAI baut ChatGPT vorausschauend aus; Drittanbieter-Plugins. Damit lockt man E-Commerce-Riesen an. Durch Webbrowser erweitert man die Fähigkeiten von GPT für Recherchezwecke. Gleichzeitig schränkt man den Bot ein: im Web darf er lesen, nicht schreiben. Wer will auch schon die Geburt von Skynet oder WOPR hautnah miterleben, oder?

Wer weiß: Vielleicht wird es irgendwann verschiedene Plugin-Stores abseits von OpenAI geben? Und wie wird etwa Google auf diese Erweiterungsmöglichkeiten reagieren?

ChatGPT-Alternativen

Welche Alternativen Dienste zum Chatbot von OpenAI können wir nutzen?

- Google Bard: Google AI hat seinen Chatbot seit Februar veröffentlicht. Bisher versteht dieser ausschließlich englisch.

- Bing Chatbot (Web-Kopilot): Microsoft nutzt GPT-Modelle für seine Bing KI. Neben der Ausgabe von Text, unterstützt Bing das Erschaffen von Bildern mithilfe vom KI-Bildgenerator DALL-E direkt im Chat.

Vorteile von KI-Textgeneratoren auf Basis von GPT

- ChatGPT für Beruf einsetzen: Hilft etwa beim Formulieren einer E-Mail-Vorlage. Oder kann Formeln für Excel via Code vorgeben.

- Für Schule: Kann unterstützen bei Hausaufgaben, etwa um Rechenwege zu beschreiben oder Informationen zu recherchieren. Jedoch mit Vorsicht einsetzen und Ausgaben beispielsweise rechnerisch prüfen – der Bot ist teilweise wirklich mies im Rechnen! ChatGPT-Plugins wie von Wolfram sollen das bald ändern.

- ChatGPT für SEO: GPT unterstützt bei Suchmaschinenoptimierung. Beispielhaft kann die KI Keywords sammeln, Suchabsichten für Schlüsselworte bestimmen, typische Fragen zum Thema finden und Antwortideen liefern. Mit Browser-Plugin wird diese Kraft erst so richtig ausgespielt! Bing KI liefert einen Vorgeschmack und hilft schon jetzt bei SEO-Bemühungen!

- Für Content: Mithilfe von GPT-Textgeneratoren lassen sich Texte und ihre Sprache klassifizieren, interpretieren und bewerten. Aber auch das Korrigieren von Rechtschreib- und Grammatikfehlern ist möglich.

Nachteile KI-Textgeneratoren basierend auf GPT

- Leblos: Unbearbeitete KI-Texte lesen sich seelenlos und inhaltsleer.

- Texte, die beispielsweise in den Worten bekannter Autoren geschrieben werden, klingen überspitzt.

- Unkreativ: Texte von Sprachmodellen sind unkreativ; sie äffen Kreativität!

- Fehlinformation: Alle machen Fehler, auch Künstliche Intelligenz ist nicht unfehlbar. Prüfe die Fakten!

- Vorurteile: Während der Arbeit an verschiedensten künstlichen Intelligenzen wird immerzu vermeldet, KI habe einen Hang zu Vorurteilen, Rassismus und Bildung von Bias. Texte sollten daher mit kritischem Blick geprüft werden!

Entwicklerzugang: So meldest du dich für die OpenAI-API an

OpenAI bietet API-Zugänge für sowohl GPT wie DALL-E und Whisper an.

Die GPT-Entwicklerschnittstelle ist dabei, entgegen der eigenen anfänglichen Gruselvorstellung, ähnlich komfortabel wie die Nutzung des Chatbots selbst.

Welche Voraussetzungen gibt es für die GPT-API?

- Programmierkenntnisse (JavaScript [NodeJS], Python, PHP [curl] oder andere)

- Ein aktiviertes Konto mit API-Schlüssel samt gratis Startguthaben (5 $). Damit testet jeder die API kostenlos.

- Ideen wie einen Chatpartner oder Artikelentwurf-Generator (Prozess mittels Variablen).

Updates zum Entwicklerzugang zur OpenAI-API

06. November 2023: Die erste OpenAI Dev-Day ist vorbei. Es gibt viele Neuigkeiten, etwa GPT-4-turbo mit 128k Tokens-Kapazitäten und günstigeren Preisen im Vergleich zu GPT-4 8k, 16k und 32k.

So kostet die gpt-4-1106-preview bloß 0.04 $ je 1k Token; statt gpt-4 0.09 $ je 1k Token.

15. Juni 2023: Für Entwickler kündigt OpenAI großartige Neuerungen an, wie Golem berichtet: Die Sprachmodelle GPT-3.5-turbo und GPT-4 erhalten mehr Möglichkeiten und werden günstiger!

Unter anderem:

- GPT-3.5-turbo und GPT-4 erhalten neuere, stabilere Versionen.

- GPT-3.5-turbo Kontextlimit wird angehoben. Vormals unterstütze diese Version 4.000 Token, nun werden es 16.000 Token sein.

- Nur GPT-4 unterstützt mehr Token, nämlich 32.000. Diese Version ist bisher jedoch nur für freigeschaltete Entwickler verfügbar.

- ChatGPT profitiert vorerst nicht von dieser Entwicklung.

- Das API-Update bietet mit der Chat Completions API neue Möglichkeiten zum Aufrufen von Funktionen (unten mehr dazu).

- Die API-Aufrufe werden günstiger: Der Preis für GPT-3.5-turbo soll um 25 % reduziert: für text-embedding-ada-002 um 75 % werden.

Welche Programmiersprachen unterstützt die API offiziell?

Offiziell unterstützte Programmiersprachen für die API sind:

- JavaScript (NodeJS)

- Python

- PHP Curl

Für JavaScript (NodeJS) nennt die API-Referenz diesen Code als Beispiel einer typischen Anfrage:

const { Configuration, OpenAIApi } = require("openai");

const configuration = new Configuration({

apiKey: process.env.OPENAI_API_KEY,

});

const openai = new OpenAIApi(configuration);

const response = await openai.createCompletion({

model: "text-davinci-003", // teures GPT-4-Modell

prompt: "HIER STEHT DER PROMPT", /* Einen Prompt reinschreiben. Übrigens: "response" beinhaltet später die Antwort, diese könne in Variablen gespeichert und wieder verschickt werden. Etwa um einen Artikelumriss zu erhalten, dem Nutzer zu präsentieren, ihn entscheiden zu lassen und den Umriss als Schreibauftrag abzuschicken sowie abarbeiten zu lassen.*/

temperature: 0, /* Zw. 0 - 1 : umso höher, umso zufälliger die Antwort */

max_tokens: 7, /* Bestimmt maximale Länge der Rückgabe in Token (1000 Token = ca. 750 Worte) -> GPT kann immer nur 4096 Token ausgeben. Ausweichmethode? Arbeitsschritte aufteilen! */

});Du siehst, auch API-Anfragen werden mittels Prompt gestellt, ähnlich wie bei ChatGPT.

Mehr Infos zum Thema API.

Funktionen-Aufruf für GPT-API

Entwickler können mit der neuen GPT-API-Version selbst definierte Funktionen aufrufen; ebenso ChatGPT-Plugins. D

Beispielsweise könnte ein User in den Chat schreiben:

Schreibe Tim eine E-Mail, ob wir uns am Freitag auf einen Kaffee treffen können.

Nun könne der Entwickler bestimmen, dass beim Kommando Schreibe eine E-Mail eine Funktion aufgerufen wird.

Eine Funktion namens send_email(to: string, body: string) {//code}; hieraus würde: send_email(to: “Tim”, body: “Hallo Tim, wollen wir am Freitag einen Kaffee trinken?”) {//code};

Schriebe der Nutzer hingegen:

Wie wird das Wetter in Hamburg?

riefe die Programmierung etwa get_current_weather(location: string, unit: “celsius” | “fahrenheit”) { //code} auf.

Des weiteren ermöglicht dieses Update, gezielt strukturierte Daten aus beispielsweise Texten zu nehmen:

Die Funktion hieße beispielsweise: extract_people_data(people: [{name: string, birthday: string, location: string}]) {//code}; und würde nun im vorgegebenen Text die Personen und ihre Daten extrahieren.

Oder Datenbank aufrufe; der User frage:

Welche Kunden haben diesen Monat den meisten Umsatz erzeugt?

Aufruf der Funktion: get_customers_by_revenue(start_date: string, end_date: string, limit: int) {//code}; würde beispielsweise eine SQL-Abfrage starten und entsprechend der Vorgaben passende Kundennamen auflisten.

Diese Szenarien sind durch die Chat Completions API möglich. Noch besser: Die Szenarien lassen sich durch Funktionen im JSON-Format beschreiben. Im eben genannten Link erhältst du weitere Eindrücke hierzu.

Entwickler-API Preisliste

Damit du die Entwickler-API von GPT-3.5 oder GPT-4 nutzen kannst, musst du dich bei OpenAI anmelden und ein Abonnement abschließen.

Anfangs erhältst du 5 $ Startguthaben, damit kannst du testen und den API-Fetch feineinstellen.

Folgende Preise entstehen für Anfragen an die API (Stand April: 2023):

| Modell | Preis (Tokens – Image – Minute – $) |

|---|---|

| GPT-3.5 (Turbo) 4K | 1000 Token ~ 750 Worte = 0,0035 $ |

| GPT-3.5 (Turbo) 16k | 1000 Token ~ 750 Worte = 0,007 $ |

| GPT-4 8k | 1000 Token ~ 750 Worte = 0,09 $ |

| GPT-4 32k | 1000 Token ~ 750 Worte = 0,18 $ |

| gpt-4-1106-preview | 1000 Token ~ 750 Worte = 0,04 $ |

| DALL-E (2) | 1024×1024 / image = 0.020 $; 512×512/ image = 0.018 $; 256×256/ image = 0.016 $; |

| Whisper | 0,006 $ / Minute (Transkribieren von Sprache zu Text) |

Ein KI-Textgeneratoren-Anbieter etwa verlangt 9 $ / Monat für 15.000 Worte, etwa 750 Worte sind 1000 Token, die kosten 0,0035 $; 15.000/750 = 20 (20.000 Token) x 0,002 € (GPT-3.5-Turbo) = 0,07 $.

Mehr dazu erfährst du in der offiziellen Preis-Referenz.

GPT-API Preisrechner für Anfragen (Beta)

Berechne die Preise für API-Anfragen an die OpenAI-GPT-API. Stand der Preise: 03.10.2023

Eine Anfrage beinhaltet sowohl das Senden vom Prompt, als auch Empfangen von der Ausgabe.

Die angezeigten Endpreise verstehen sich als ungefähr Einheiten.

Wähle dein OpenAI-API GPT-Modell:

| Token je Anfrage | Worte je Anfrage | Preis je Anfrage ($) | Preis je Anfrage(n) ($) |

|---|---|---|---|

| 1000

|

750

|

||

| Token | Worte | Preis je Token | Summe ($) |

1

|

1

|

– |

|

| *Ausgaben abgerundet | **Ausgaben Schätzwerte |

OpenAI bietet übrigens die Möglichkeit, Token genauer zu berechnen (Tokenizer). Mit diesem Tool wird klar: Verschiedene Buchstaben werden verschieden gewichtet. Schnell fallen uns die Sonderlinge „Ä“, „Ö“, „Ü“ ein: Tatsächlich zählen diese Zeichen je 2 Token! Ähnlich verhält es beispielhaft mit dem Zeichen „E“.

Alternativen zu OpenAI für Entwickler finden und testen

Neben dem GPT-Playground von OpenAI bieten sich weitere große Sprachmodelle zum Erproben an, wie die folgende Liste beweist:

- Hugging Face: Eine Plattform für Maschinelles Lernen, die eine Vielzahl von NLP-Modellen (Natural-Language-Processing) anbietet, darunter auch GPT-Modelle.

- Google Cloud AI Platform: Ein Cloud-basiertes Toolset von Google, das maschinelles Lernen und künstliche Intelligenz unterstützt, einschließlich der Möglichkeit, Textgenerierung mit GPT-Modellen zu trainieren und auszuführen.

- GPT4ALL: Ein Open-Source-Chatbot und Sprachmodell. Benötigt gute Hardware, auch wenn der Entwickler das Tool auf einem M1-Prozessor laufen lässt.

- AI Horde: Eine Gemeinschaft aus zusammengeschlossenen Servern, die Open-Source-KI kostenfrei zur Verfügung stellt. Mit API! Es werden etwa Bildgeneratoren und Textgeneratoren geboten!

Fazit

Haben dir die GPT-Befehle aus der Liste geholfen?

Ich hoffe!

Und hoffentlich haben dir auch die weiteren Themen geholfen!

Jedenfalls weißt du jetzt, wie du optimale Anweisungen für Chatbots schreibst: Erkläre der Maschine spezifisch ihre Aufgabe, etwa wie ein Werbemanager oder Social Media Manager zu handeln. Nenne, was du machen wirst, was du erwartest und versichere dich, ob der Bot verstanden hat. Liefere Beispiele wie Texte oder Strukturen. Erinnere den Bot zwischendrin an seine Aufgabe!

Beispiel-Prompt:

Du bist ein spaßiger und motivierender Social Media Manager und du schreibst für mich Tweets für folgendes [Thema] und du nutzt gerne passende Emojis!So habe ich bisher beste Ergebnisse erzielt. Jedenfalls für Sammelaufgaben wie Schlüsselwörter, Synonyme sowie sonstige Daten. Oder Daten in Tabellen einfügen lassen, JavaScript Syntax und Beispiele suchen lassen und so weiter.

Die Beispiele die ich bisher für JavaScript generieren ließ beinhalten oftmals Fehler. Entweder fehlt ein Teil des HTML-Codes oder es kommt aufgrund von fehlerhaften Syntax-Gebrauch zu Laufzeitfehlern.

Dennoch nützt GPT einem Entwickler; etwa beim Recherchieren zu Fehlern beim Einarbeiten in neue Gefilde wie React. So entfällt die, im Vergleich, doch eher mühsame Suche via Google, Stackoverflow.

(Dies dürfte anderen Menschen ähnlich ergehen, daher dürfte auch dieses Internet, wie wir es kennen, gefährdet sein. Lies mehr hierzu: Generative Sucherfahrung in der Google-Suche: Google probt Künstliche Intelligenz)

Zurück zum Schreiben mit KI: Für das Schreiben von längeren sowie lesenswertem Text taugt eine KI nichts. Jedenfalls ohne unser Eingreifen, denn KI-Textgeneratoren neigen zum Plattenspielen und wiederholt alle paar hundert Worte den Inhalt.

Obendrein liest sich und klingt das Geschriebene wie aus einer einheitlichen Tonleiter. Jeder tropfende Wasserhahn klingt abwechslungsreicher. Das mag für Shop-Artikelbeschreibungen reichen; wohlgemerkt für Artikel, bei denen der Kaufmann sich eh keine großartigen Hoffnungen mehr mache.

Freilich hilft nicht einmal der Versuch, die Sätze durch Stilvorgaben bekannter Autoren zu schmücken. Es liest sich gleich wie Parodie, weil der Einsatz übertrieben klingt.

Versuch es mal; lass ChatGPT in den Worten Stephen Kings schreiben. Da wimmelt es dann vor den Wörtchen Dunkelheit, Gefahr und Kreaturen; aber nicht vom Schreibstil Kings.

Den Texten fehlt die Seele. Es fehlen:

- der besondere Blick auf die Sache,

- die Lebensweisheit,

- die Bilder.

Probiere auch weitere Autoren oder Sprecher von TED Talks etwa.

KI hingegen verstanden als Teil eines Workflows für die Sammlung von Ideen oder Überschriften und als Anstoß für das Formulieren neuer Inhalte, diene ein künstlicher Text-Assistent womöglich als nützlicher, unterstützender und mögliches, inspirierendes Tool.

Aber: Es kann nichts, was nicht jeder andere mit einer Formelsammlung vermag.

Die Verwendung von KI verhält sich endlich wie die des Taschenrechners: Beides fördert die Faulheit. Beides senkt die Leistung. Beide sorgen für kreative Stumpfheit. Wer nicht selbst denkt, der verlerne diese Gabe irgendwann, wie Menschen das Kommunizieren verlernen, wenn sie sich langzeitig aus jeglicher sozialen Interaktion zurückziehen.

Und einen denkenden, ja einen motivierten Mitarbeiter ersetzen die Sprachmodelle jedenfalls nicht.

Bisher.

Fotograf, Model oder Designer? DALL-E und Midjourney machen diesen Berufsbildern gefährliche Konkurrenz! Lies mehr: KI-Bildgeneratoren mittels DALL-E, Midjouney und StableDiffusion.

Passend zum Weiterlesen

Weiterführende Informationen & Quellen

- Weitere Ideen für ChatGPT Befehle: Awesome Prompts Ideas, …

- OpenAI Prompt Engineering-Hilfeartikel (Englisch)

- Wikipedia über Prompt Engineering (Deutsch)

- PromptBard – Prompt Engineering (Aufbau)

Häufige Fragen

🤖 ChatGPT Prompts für Bing KI (Web-Copilot)?

Viele hier gezeigten Beispiele funktionieren, einige nicht.

Falls fehler entstehen, müssen die Befehle in Fragen umgestellt werden.

Beispiel:

Statt anzuweisen: „Agiere wie ein Werbetexter“, schreibe: „Formuliere 3 Titel-Ideen für einen Blogpost über Künstliche Intelligenz.“

Schaue hier für mehr Tipps zu Microsofts Bing KI (Web-Kopiloten).

Wie viel kostet die GPT-Api?

Die API bietet verschiedene Sprachmodelle an.

GPT-3.5-turbo bietet das beste Preis-Leistungs-Niveau: 1000 Token kosten 0,002 $. 1000 Token entsprechen etwa 750 Wörter.

GPT-4 fordert 0,06 $ je 1000 Token.

Welche Funktionen bringen ChatGPT-Plugins?

Plugins für ChatGPT bringen folgende Möglichkeiten:

- Bessere Recherche: Statt dem begrenzten Wissensstand von GPT werden Webseiten direkt aufgerufen, gelesen und zusammengefasst.

- Interaktion mit Web: Nutzer können auf Befehl etwa Tischplatzreservierungen vornehmen, beim Italiener oder Lebensmittelhändler bestellen.

- GPT mit Lieblingsdiensten nutzen: Möglicherweise können wir bald Google-Dienste und dergleichen mittels Chatbot steuern.

Kann ich selbst ChatGPT-Plugins programmieren?

Ja, beschrieben wird es in der offiziellen Dokumentation.

Ablauf einer GPT-Plugin-Entwicklung:

- Du musst freigeschalteter Entwickler sein (Warteliste)

- Du solltest Kenntnisse in Python besitzen

- Du wirst eine Manifest-Datei im .JSON-Format erstellen und auf deinem Server hosten. Die Datei enthält verschiedene Informationen wie Autorisierung, Endpunkte.

- Du musst dein Plugin im ChatGPT User-Interface (UI) registrieren

- Plugins müssen von Benutzern im UI manuell aktiviert werden, deine Plugins werden nicht von selbst verwendet.

Gut zu wissen:

- Plugins, die POST-Statement verwenden, also Daten senden oder schreiben, müssen den Nutzer vor jedem Senden um deren Erlaubnis fragen.

- Vorerst können nur 15 Benutzer ein unabhängiges Plugin nutzen.

- GPT entscheidet, ob dein Plugin eingesetzt wird.

🤖 Wie schreibe ich einen guten ChatGPT Befehl?

Ein guter ChatGPT-Befehl sollte klar und präzise formuliert sein. Verwende einfache Sprache und vermeide unnötige Wörter oder Sätze. Es ist auch wichtig, den Befehl in einer Weise zu formulieren, die von ChatGPT leicht verstanden werden kann. Einige Tipps sind, den Befehl in Frageform zu formulieren oder Schlüsselwörter und Synonyme zu verwenden, um die Genauigkeit der Antwort zu erhöhen. Obendrein lohnt sich das Eingeben von Beispielen.

Finde mehr zum Thema Prompts für ChatGPT!

📕 Kann ich mit ChatGPT Romane schreiben?

Ja, es ist möglich, mit ChatGPT einen Roman zu schreiben. ChatGPT kann dabei helfen, Charaktere und Szenen zu entwickeln sowie Dialoge zu schreiben. Es ist jedoch wichtig zu beachten, dass ChatGPT nicht perfekt ist und dass es keine Garantie dafür gibt, dass die erstellten Texte gut sind oder den gewünschten Stil und Ton treffen.

Kann ich selbst mit Künstlicher Intelligenz arbeiten (z.B. TensorFlow)?

Ja, es gibt verschiedene freie Lernumgebungen für KI. Leider ist der Lernvorgang und der Einsatz energiehungrig.

Welche Versionen von ChatGPT gibt es?

Es gibt mehrere Versionen von ChatGPT, die von OpenAI entwickelt wurden, einschließlich GPT-2, GPT-3 und GPT-4. Diese Modelle sind in der Lage, natürliche Sprache zu verstehen und menschenähnliche Antworten zu generieren. Je höher die Version, desto leistungsfähiger ist das Modell und desto bessere Antworten kann es geben.

Kann ich mit ChatGPT programmieren?

ChatGPT kann dir als Code-Reviewer oder Codelern-Mentor behilflich sein. Sage GPT es solle sich wie eine Webentwicklerkonsole für JavaScript verhalten, dich verbessern und korrigieren. Schließlich gibst du ihm Beispielcode-Zeilen und lässt dich belehren. Sei aber vorsichtig beim Nutzen von vorgeschlagenen Beispiel-Programmcode; nutze nur das, was du auch verstehst!

Kann ich als Entwickler mit ChatGPT arbeiten?

GPT kann nicht direkt programmiert werden, da es sich um ein vortrainiertes KI-Modell handelt. Allerdings gibt es API und Plugins, die es Entwicklern ermöglichen, ChatGPT in ihre Anwendungen und Websites zu integrieren. Die API ermöglichen es Entwicklern, Anfragen an ChatGPT zu senden und Antworten zu erhalten, die dann in ihren Anwendungen verwendet werden können. Plugins können innerhalb von ChatGPT eingesetzt werden und bieten Möglichkeiten, eigene Dienste in den Chatbot einzubauen.

Welche Sprachen spricht ChatGPT?

ChatGPT wurde hauptsächlich auf Englisch trainiert und ist in der Lage, in dieser Sprache menschenähnliche Antworten zu generieren. Es gibt jedoch auch Versionen, die in anderen Sprachen trainiert wurden, einschließlich Chinesisch, Französisch, Deutsch und Spanisch. Außerdem spricht GPT Programmiersprachen, beispielhaft: JavaScript, PHP, Python. Oder Auszeichnungssprachen: HTML, CSS und weitere.

Was bietet OpenAI noch an?

OpenAI bietet neben ChatGPT Playgorund folgendes an:

- API für eigene Apps nutzen

- Whisper, um Sprache in Text zu wandeln (funktioniert selbst mit YouTube-Videos!)

- Textgeneratoren (Programmcode, Text): GPT-Modelle 1 bis 4

- Bildgenerator: Dall-E 1 und 2

- Weiteres

Welchen KI-Textgeneratoren solle ich nutzen?

Es kommt drauf an.

Hast du vor Geld auszugeben, ergeben sich viele Möglichkeiten.

Zum aktuellen Moment empfiehlt sich ChatGPT (Pro) zu nutzen.

Die meisten anderen Anbieter wie Jasper AI, Rytr AI und weitere nutzen OpenAIs GPT-API und die API wird durch Prompts (ähnlich wie im Chat auch) angefragt. Grundsätzlich können die Tools nicht mehr wie ChatGPT.

Kann ich mit ChatGPT ganze Blogartikel schreiben?

Ja.

Aber du musst die Ausgaben stückeln und überarbeiten.

Folgender Ablauf für einen Artikel wäre möglich:

- Weise GPT darauf hin, dass es einen Blogartikel schreiben soll

- Gebe Zielgruppe, Stil und Wortwahl vor

- Generiere eine Artikelstruktur, die du bearbeitet haben möchtest

- Lasse GPT für jede einzelne Überschrift Inhalt verfassen (am besten lässt du dir je Überschrift eine Ausgabe geben!)

- Überarbeite den Inhalt und veröffentliche einen Blog-Post

Lohnen sich ChatGPT-Kurse?

Nein, alles an Wissen findest du im Netz. Wenn nicht von deutschen Bloggern, dann von englischen.